Inhaltsverzeichnis

- 1 Warum XML-Sitemaps trotz moderner Suchmaschinen weiterhin relevant sind

- 2 Was eine XML-Sitemap ist und was sie leistet

- 3 Wie Suchmaschinen Sitemaps tatsächlich nutzen

- 4 Aufbau und Struktur einer XML-Sitemap verständlich erklärt

- 5 Wann eine XML-Sitemap wirklich einen Unterschied macht

- 6 Unterschiedliche Arten von Sitemaps und ihre Einsatzbereiche

- 7 Internationalisierung: hreflang im Head oder in der Sitemap

- 8 Typische Fehler, die die Wirkung von Sitemaps einschränken

- 9 XML-Sitemaps als Werkzeug für die Indexierungskontrolle

- 10 Best Practices: Wie eine gute XML-Sitemap in der Praxis aussieht

- 11 Handlungsempfehlungen für die Umsetzung

- 12 FAQ

Warum XML-Sitemaps trotz moderner Suchmaschinen weiterhin relevant sind

Suchmaschinen sind heute gut darin, Websites eigenständig zu erkunden. Interne Verlinkung, externe Signale, semantische Analyse: In vielen Fällen reicht das aus, um Inhalte zuverlässig zu erfassen. Bei wachsenden Websites führt das zu einer verbreiteten Fehleinschätzung, nämlich dass eine Sitemap verzichtbar sei.

Dabei ist die Ausgangslage einfach: Ohne Sitemap entscheidet der Crawler selbst, was er wann besucht. Er tut das auf Basis von Signalen, die für neue oder strukturell schlecht verlinkte Inhalte häufig schlicht fehlen. Eine gepflegte Sitemap kann die Entdeckung neuer Inhalte erleichtern und die Wahrscheinlichkeit erhöhen, dass Google neue URLs früher berücksichtigt. Eine Zeitgarantie gibt es dabei nicht. Google beschreibt Sitemaps als Möglichkeit, Informationen über Seiten, Videos und andere Inhalte bereitzustellen, einschließlich Details darüber, wann Inhalte zuletzt aktualisiert wurden. (Google Developers: Sitemaps Übersicht)

Was eine XML-Sitemap ist und was sie leistet

Eine XML-Sitemap ist eine strukturierte Datei, die die wichtigsten URLs einer Website in einem standardisierten Format zusammenfasst, ergänzt durch Metadaten wie den Zeitpunkt der letzten Aktualisierung.

Wichtig ist dabei die richtige Erwartungshaltung: Die Sitemap ist eine Empfehlung an den Crawler, kein Befehl. Eine URL in der Sitemap wird für Google leichter sichtbar, aber Google entscheidet selbst, ob und wann sie gecrawlt und indexiert wird. Qualitätsprobleme einer Seite, dünner Inhalt, fehlende Verlinkung, langsame Ladezeit, werden durch eine Sitemap weder verdeckt noch behoben. Google weist ausdrücklich darauf hin, dass eine Sitemap keine Garantie für die Aufnahme in den Index darstellt. (Google Developers: Sitemap erstellen)

Wer sie als präzises Kommunikationsmittel an den Crawler versteht, nutzt sie richtig.

Wie Suchmaschinen Sitemaps tatsächlich nutzen

Bei sehr großen oder häufig aktualisierten Websites spielen Crawling-Ressourcen eine größere Rolle. Dort hilft eine gepflegte Sitemap, Google wichtige URLs und Änderungen klar zu signalisieren. Konkret wird sie vor allem in vier Situationen relevant:

- Neue Inhalte ohne externe Verlinkung: Ein frisch veröffentlichter Artikel hat noch keine eingehenden Links von anderen Websites. Die Sitemap gibt Google einen Hinweis auf seine Existenz.

- Tief verlinkte Seiten: Seiten, die erst nach mehreren Klicks erreichbar sind, werden ohne diesen Hinweis seltener berücksichtigt.

- Häufig aktualisierte Inhalte: Häufig aktualisierte Inhalte, wie z.B. Preisseiten oder Nachrichtenartikel profitieren davon, wenn der Crawler aktiv über Änderungen informiert wird.

- Medieninhalte, Bilder und Videos: Sie helfen spezialisierte Sitemaps dabei, diese Inhalte gezielt an Google zu melden.

Die interne Verlinkung bleibt dabei das stärkste Signal. Eine Sitemap ergänzt sie.

Aufbau und Struktur einer XML-Sitemap verständlich erklärt

Die technische Struktur einer Sitemap ist übersichtlicher als sie auf den ersten Blick wirkt: Jede URL wird als eigener Eintrag definiert, optional ergänzt durch Metadaten.

Der wichtigste Wert neben der URL selbst ist der Zeitstempel der letzten Änderung. Zwei weitere Felder, Aktualisierungshäufigkeit und Priorität, sind zwar Teil des Standards, spielen für Google aber eine deutlich geringere Rolle. Der Aufwand für deren Pflege lohnt sich kaum.

Entscheidend ist stattdessen, dass jede enthaltene URL erreichbar ist, eine gültige Antwort liefert und die kanonische Version der Seite darstellt. Genau hier entstehen in der Praxis die meisten Fehler.

Wann eine XML-Sitemap wirklich einen Unterschied macht

Bei einem kleinen Auftritt mit überschaubarer Navigation spielt eine Sitemap kaum eine Rolle. Bei einem Onlineshop mit Tausenden Produktseiten oder einem Blog mit wöchentlichen Veröffentlichungen wird sie zum wichtigen Bestandteil der technischen Infrastruktur.

| Szenario | Warum eine Sitemap hilft |

| Große Websites | Vollständige Übersicht für den Crawler, verhindert blinde Flecken |

| Neue Domains | Frühere Berücksichtigung, bevor externe Verlinkung aufgebaut ist |

| Komplexe Strukturen | Bessere Erreichbarkeit tief verlinkter Seiten |

| Häufige Aktualisierungen | Crawler wird aktiv über Änderungen informiert |

| Internationale Websites | Klare Zuordnung von Sprachversionen |

Unterschiedliche Arten von Sitemaps und ihre Einsatzbereiche

Die klassische XML-Sitemap bildet die Grundlage. Daneben existieren spezialisierte Varianten für bestimmte Inhaltstypen, jede mit eigenem Zweck:

| Sitemap-Typ | Einsatzbereich | Besonderheit |

| Standard XML-Sitemap | Alle indexierbaren Seiten | Basis für das Crawling |

| Image Sitemap | Bilder | Hilft Google, Bilder zu entdecken und besser zu verarbeiten |

| Video Sitemap | Videos | Hilft Google, Videoinhalte zu finden und zu verstehen |

| News Sitemap | Aktuelle Nachrichten | Für Publisher, die Nachrichteninhalte strukturiert melden möchten |

| Sitemap Index | Große Websites | Bündelt mehrere Sitemaps in einer Datei |

Bild- und Video-Sitemaps sind besonders dann sinnvoll, wenn Medieninhalte eine zentrale Rolle für Sichtbarkeit und Reichweite spielen. News-Sitemaps richten sich an Verlage und Nachrichtenanbieter, die ihre Inhalte Google strukturiert und zeitnah melden möchten, und unterliegen eigenen technischen Anforderungen. Google stellt für jede Variante separate Spezifikationen bereit. (Google Developers: Sitemap-Typen)

Internationalisierung: hreflang im Head oder in der Sitemap

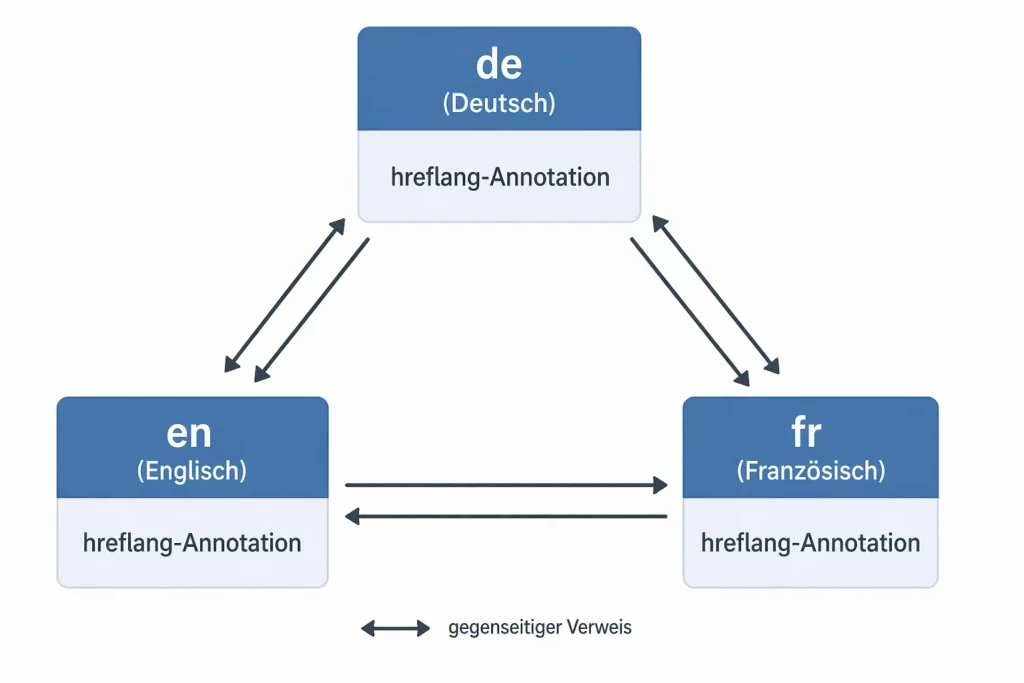

Sobald eine Website in mehreren Sprachen oder für unterschiedliche Länder verfügbar ist, muss sie Suchmaschinen mitteilen, welche Version für welche Zielgruppe gedacht ist. Das geschieht über hreflang-Annotationen, einen Mechanismus, der konzeptionell einfach klingt und in der Praxis zu den häufigsten Fehlerquellen im technischen SEO gehört.

hreflang lässt sich auf drei Wegen implementieren: im HTML-Head jeder Seite, per HTTP-Header oder in der XML-Sitemap. Für kleinere Websites mit wenigen Sprachversionen ist der HTML-Head übersichtlich und ausreichend. Bei vielen Seiten und mehreren Sprachvarianten wird dieser Ansatz fehleranfällig, denn jede Seite muss auf alle ihre Sprachvarianten verweisen, und umgekehrt. Fehlende oder widersprüchliche Verweise können dazu führen, dass Google die Sprachbeziehungen nicht wie beabsichtigt interpretiert. Die Sitemap-Implementierung löst dieses Problem, weil alle hreflang-Beziehungen zentral an einem Ort gepflegt werden. Änderungen lassen sich konsistent umsetzen, ohne jede einzelne Seite anfassen zu müssen. Google unterstützt beide Varianten ausdrücklich. (Google Developers: Lokalisierte Versionen)

Was in der Praxis immer wieder schiefgeht: beide Methoden parallel und widersprüchlich einzusetzen. Das erzeugt konkurrierende Signale, mit der Folge, dass Suchmaschinen keine eindeutige Zuordnung treffen können.

Typische Fehler, die die Wirkung von Sitemaps einschränken

Die größte Herausforderung bei Sitemaps liegt selten in der Erstellung, sondern in der Pflege. Drei Fehler tauchen dabei besonders häufig auf:

- Weiterleitungen statt Ziel-URLs Wenn eine URL in der Sitemap auf eine Weiterleitung zeigt statt direkt auf die Zielseite, muss der Crawler einen zusätzlichen Schritt machen. Bei Hunderten solcher Einträge summiert sich das zu verschwendeten Crawling-Ressourcen. Sitemaps sollten ausschließlich die finale, kanonische URL eines Inhalts enthalten.

- Seiten mit noindex-Tag Eine Seite ist per noindex-Tag von der Indexierung ausgeschlossen und taucht gleichzeitig in der Sitemap auf: Die Sitemap signalisiert dem Crawler, die Seite zu berücksichtigen, das noindex-Tag das Gegenteil. Dieser Widerspruch kostet Crawling-Ressourcen und sendet inkonsistente Signale. Solche Seiten tauchen in der Search Console typischerweise als ausgeschlossen auf, weil Google ein noindex-Signal erkannt hat.

- Veraltete URLs Wer Inhalte löscht, umstrukturiert oder URLs ändert, ohne die Sitemap zu aktualisieren, schickt den Crawler regelmäßig ins Leere. Das reduziert die Zuverlässigkeit der Sitemap als Ganzes, denn Suchmaschinen bewerten über Zeit, welche Quellen verlässliche Signale liefern.

XML-Sitemaps als Werkzeug für die Indexierungskontrolle

Das Diagnosepotenzial von Sitemaps wird in der Praxis oft unterschätzt. Dabei lässt sich mit einem einfachen Abgleich, URLs in der Sitemap gegen tatsächlich indexierte Seiten, eine Menge über den Zustand einer Website erfahren.

Die Google Search Console liefert dafür alle nötigen Daten. Unter „Seiten“ lässt sich einsehen, welche URLs gecrawlt, welche indexiert und welche aus welchem Grund ausgeschlossen wurden. Drei Fragen strukturieren diese Analyse:

- Welche Seiten sind indexiert, ohne in der Sitemap zu stehen? Das kann auf ungewollte Indexierung hinweisen, etwa von URL-Parametern, Testseiten oder Duplikaten.

- Welche Seiten stehen in der Sitemap, werden aber nicht indexiert? Das ist ein Hinweis auf ein Qualitätsproblem, entweder überzeugt der Inhalt Google nicht, oder es gibt technische Widersprüche wie noindex-Tags oder kanonische Verweise auf andere URLs.

- Gibt es Muster bei ausgeschlossenen URL-Typen? Wenn systematisch bestimmte Strukturen ausgeschlossen werden, liegt oft ein Problem vor, das sich nur durch inhaltliche oder technische Korrekturen beheben lässt, nicht durch Sitemap-Anpassungen.

Best Practices: Wie eine gute XML-Sitemap in der Praxis aussieht

Eine gute Sitemap ist keine komplizierte Konstruktion, sondern eine konsistente. Sie enthält ausschließlich URLs, die indexiert werden sollen, wird automatisch aktualisiert und regelmäßig auf Fehler geprüft.

| Prinzip | Bedeutung in der Praxis |

| Nur indexierbare URLs | Keine noindex-Seiten, keine Weiterleitungen, keine nicht erreichbaren Seiten |

| Aktuelle Inhalte | Gelöschte oder verschobene Seiten sofort entfernen |

| Kanonische URLs | Immer die Zielversion, nie eine weiterleitende URL |

| Automatische Generierung | Neue Inhalte werden zuverlässig erfasst |

| Referenz in der robots.txt | Sitemap wird auch ohne manuelles Einreichen gefunden |

Eine regelmäßige Überprüfung über die Google Search Console empfiehlt sich als fester Bestandteil eines monatlichen SEO-Audits.

Handlungsempfehlungen für die Umsetzung

Der sinnvolle Einstieg beginnt mit einer Entscheidung: Welche Inhalte sollen indexiert werden, und welche nicht? Diese Frage bestimmt, was in die Sitemap aufgenommen wird. Anschließend lohnt es sich, die Generierung zu automatisieren, damit neue Inhalte ohne manuellen Aufwand erfasst werden. Gängige Inhaltsverwaltungssysteme wie WordPress bieten dafür fertige Lösungen über Erweiterungen.

Nach der Veröffentlichung beginnt der wichtigste Teil: die kontinuierliche Überwachung. Über die Google Search Console lassen sich Fehler erkennen, Indexierungsprobleme analysieren und Muster identifizieren, die auf tieferliegende strukturelle Schwächen hinweisen. So wird die Sitemap zu einem aktiven Instrument der Qualitätssicherung.

FAQ

Eine XML-Sitemap ist eine strukturierte Datei, die wichtige URLs einer Website enthält und Suchmaschinen beim Crawling unterstützt. Sie funktioniert wie ein Inhaltsverzeichnis, das der Website-Betreiber aktiv pflegt.

Suchmaschinen können Websites auch ohne Sitemap erfassen. Bei großen, neuen oder strukturell komplexen Websites ist sie ein wesentliches Hilfsmittel, bei vielen Medieninhalten besonders sinnvoll.

Eine einzelne Sitemap darf maximal 50.000 URLs enthalten oder 50 MB groß sein. Bei größeren Websites werden mehrere Sitemaps über eine Sitemap-Index-Datei gebündelt.

Sitemaps können in der Google Search Console eingereicht werden. Zusätzlich sollte die Sitemap-URL in der robots.txt referenziert werden, damit sie auch von anderen Crawlern automatisch gefunden wird.

Für kleine Websites mit wenigen Sprachversionen eignet sich der HTML-Head. Bei größeren Projekten ist die Sitemap die verlässlichere Lösung, weil alle Sprachbeziehungen zentral gepflegt werden und Inkonsistenzen leichter vermieden werden.

Aktuellste Artikel

XML-Sitemap erstellen und optimieren: Ein technischer Leitfaden

KI-Texte vermenschlichen: Was Studien wirklich zeigen

Google AI Mode, WebMCP und die neue Logik digitaler Sichtbarkeit