Inhaltsverzeichnis

- 1 Was ist Claude Mythos Preview?

- 2 Warum Claude Mythos Preview als Wendepunkt gilt

- 3 Das eigentliche Problem: Das Zeitfenster für Verteidigung schrumpft

- 4 Project Glasswing: Verteidigung mit Vorsprung

- 5 Was Unternehmen jetzt konkret tun sollten

- 6 Besondere Risiken nach Branche

- 7 Die politische Dimension von Claude Mythos Preview

- 8 Alarm ist berechtigt, Panik nicht

- 9 FAQ

Claude Mythos Preview – ein KI-Modell, das Schwachstellen in realer Software findet, analysiert und zu praktischen Angriffspfaden verdichten kann – steht im Zentrum einer Sicherheitsdebatte, die längst über Fachkreise hinausgeht.

Was ist Claude Mythos Preview?

Claude Mythos Preview ist ein leistungsstarkes Sprachmodell von Anthropic, das gezielt auf Aufgaben der Cybersicherheit getestet wurde. Es kann Quellcode untersuchen, Schwachstellenhypothesen entwickeln, diese in isolierten Testumgebungen praktisch überprüfen und die Ergebnisse in technischen Berichten dokumentieren.

Der entscheidende Unterschied zu klassischen Sicherheitswerkzeugen liegt in der Arbeitsweise. Mythos beantwortet keine Einzelfragen über Code. Das Modell plant und führt mehrere Schritte hintereinander aus: Es liest Programmteile, sucht nach verdächtigen Mustern, prüft Annahmen, verwirft falsche Spuren und arbeitet weiter, bis ein Befund plausibel oder widerlegt ist. Damit nähert es sich einer Form automatisierter Sicherheitsforschung.

Anthropic beschreibt das Modell ausdrücklich als nicht allgemein freigegebenes Frontier-Modell mit auffällig starken Fähigkeiten bei Computersicherheitsaufgaben. Dass ein Unternehmen ein Modell zurückhält, weil seine Fähigkeiten als zu riskant gelten, ist selbst bereits eine sicherheitspolitische Aussage.

Warum Claude Mythos Preview als Wendepunkt gilt

Cybersicherheit war schon immer ein Wettlauf zwischen Angreifern und Verteidigern. Neue Werkzeuge verändern diesen Wettlauf. Mythos ist deshalb relevant, weil es mehrere bisher getrennte Fähigkeiten verbindet.

Codeverständnis in der Tiefe

Klassische Scanner erkennen bekannte Schwachstellentypen und unsichere Funktionsaufrufe. Das ist nützlich, aber begrenzt. Viele schwerwiegende Fehler entstehen erst durch komplexe Wechselwirkungen zwischen Programmteilen. Ein leistungsfähiges Sprachmodell kann Quellcode nicht nur zeilenweise betrachten, sondern semantische Beziehungen erkennen: wie Daten fließen, welche Annahmen Entwickler getroffen haben, wo eine Eingabe unter bestimmten Bedingungen gefährlich werden könnte.

Praktische Verifikation statt theoretischer Warnung

Eine potenzielle Sicherheitslücke ist noch kein belastbarer Befund. Sicherheitsforscher müssen prüfen, ob sie reproduzierbar ist, welche Voraussetzungen nötig sind und ob sie tatsächlich ausgenutzt werden kann. Anthropic beschreibt Verfahren, bei denen Mythos nicht nur eine Schwachstelle meldet, sondern in einer isolierten Umgebung überprüft, ob der Befund belastbar ist. Das unterscheidet theoretische Warnungen von praktisch relevanten Problemen – und ist für Unternehmen ein zweischneidiger Fortschritt. Defensiv sinkt die Zahl unklarer Meldungen. Offensiv kann sich die Zeit vom Verdacht bis zur möglichen Ausnutzung verkürzen.

Mehrstufige Angriffsketten

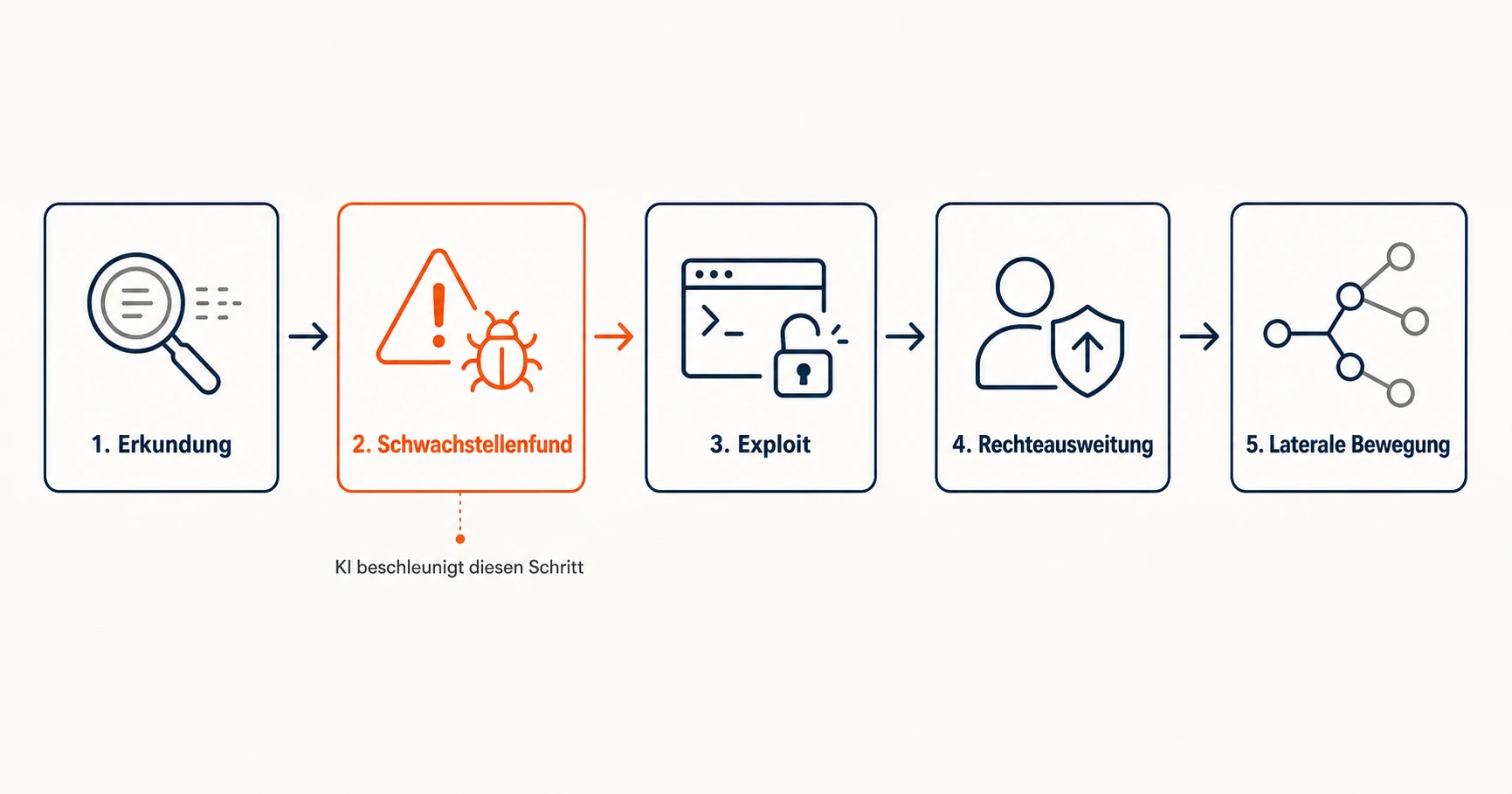

Moderne Angriffe bestehen selten aus einem einzelnen Exploit. Häufig beginnt ein Einbruch mit einer kleinen Schwachstelle, danach folgen Rechteausweitung, laterale Bewegung und das Verschleiern von Spuren. Das AI Security Institute berichtet, dass Mythos Preview bei mehrstufigen Cyberangriffssimulationen deutliche Fortschritte zeigte. Solche Tests sind relevanter als einfache Einzelaufgaben, weil sie näher an realen Angriffsszenarien liegen. Nicht nur der einzelne Fund wird dadurch automatisierbarer, auch die Verbindung mehrerer Teilschritte zu einer Angriffskette.

Das eigentliche Problem: Das Zeitfenster für Verteidigung schrumpft

Die wichtigste Konsequenz liegt in der Zeit. Bisher lag zwischen dem Entdecken einer Schwachstelle und ihrer massenhaften Ausnutzung oft ein nutzbares Zeitfenster. Sicherheitsforscher meldeten den Fehler, Hersteller prüften den Befund, Patches wurden entwickelt, Unternehmen spielten Updates ein.

Dieses Modell funktioniert nur, wenn Verteidiger schnell genug sind. Wenn KI die Suche und Validierung von Schwachstellen beschleunigt, geraten klassische Patch-Prozesse unter Druck. Gleichzeitig bedeutet mehr Automatisierung auch mehr gefundene Schwachstellen und damit mehr Arbeit für ohnehin knappe Sicherheitsteams. Das eigentliche Nadelöhr liegt nicht in der Erkennung, sondern in der Umsetzung: Wer entwickelt den Patch? Wer testet ihn? Wer stellt sicher, dass kritische Systeme dabei nicht ausfallen?

Hinzu kommt die Skalierung. Ein menschlicher Sicherheitsexperte kann nur eine begrenzte Zahl von Projekten untersuchen. Ein KI-Agent kann potenziell in vielen Instanzen parallel arbeiten. Was früher zu teuer oder zu zeitintensiv war, kann mit KI für mehr Akteure erreichbar werden, darunter auch solche mit weniger legitimen Absichten.

Project Glasswing: Verteidigung mit Vorsprung

Project Glasswing ist Anthropics Antwort auf dieses Dilemma. Ausgewählte Partner erhalten Zugang zu Mythos Preview, um kritische Software früher zu prüfen und Lücken zu schließen, bevor vergleichbare Fähigkeiten breiter verfügbar werden. Zu den genannten Partnern zählen AWS, Apple, Broadcom, Cisco, CrowdStrike, Google, JPMorgan Chase, die Linux Foundation, Microsoft, Nvidia und Palo Alto Networks.

Die Logik dahinter ist klar: Wenn leistungsfähige KI-Modelle Schwachstellen schneller finden können, müssen Verteidiger diese Fähigkeit zuerst nutzen. Große Plattformen, Betriebssystemhersteller, Cloud-Anbieter und Sicherheitsunternehmen erhalten dadurch eine Chance, besonders wichtige Komponenten frühzeitig zu härten.

Doch dieser Ansatz hat eine strukturelle Grenze: Viele kritische Systeme liegen nicht bei den großen Tech-Konzernen. Mittelständische Unternehmen, Kommunen, Kliniken, Industrieanlagen und Open-Source-Projekte haben oft weniger Ressourcen und keine Verbindung zu Project Glasswing. Genau dort kann die Schutzlücke wachsen.

Open Source verdient dabei besondere Aufmerksamkeit. Betriebssysteme, Cloud-Dienste, Unternehmensanwendungen und Sicherheitsprodukte nutzen unzählige Bibliotheken und Frameworks, die oft von kleinen Teams gepflegt werden. Wenn KI sehr viele qualifizierte Schwachstellenberichte erzeugt, kann das Open-Source-Ökosystem überfordert werden. Maintainer müssen Fehler prüfen, Patches entwickeln, Nutzer informieren und Koordination leisten. Dafür fehlen oft Zeit und Geld.

Was Unternehmen jetzt konkret tun sollten

Software-Inventar aufbauen und pflegen

Unternehmen müssen wissen, welche Software sie verwenden. Dazu zählen eigene Anwendungen, Standardsoftware, Cloud-Dienste, Container-Images, Open-Source-Bibliotheken und transitive Abhängigkeiten. Ohne Inventar ist jede Sicherheitswarnung ein Suchprojekt. Mit Inventar wird sie zur priorisierbaren Aufgabe. Eine Software Bill of Materials wird damit zur operativen Grundlage.

Patch-Prozesse risikobasiert beschleunigen

Monatliche Update-Zyklen reichen für kritische Systeme oft nicht mehr aus. Wichtige Fragen für eine sinnvolle Priorisierung: Ist das System aus dem Internet erreichbar? Gibt es aktive Ausnutzung? Erlaubt die Lücke Rechteausweitung? Sind sensible Daten betroffen? Gibt es bereits einen Patch oder Kompensationsmaßnahmen?

Least Privilege konsequent umsetzen

Systeme, Dienste und Nutzerkonten sollten nur die Rechte besitzen, die sie tatsächlich benötigen. Segmentierung, Rollenmodelle, starke Authentifizierung und lückenlose Protokollierung gehören daher zum Basisschutz. Ein einzelner erfolgreicher Angriff darf nicht automatisch zum vollständigen Kontrollverlust führen.

KI defensiv und kontrolliert einsetzen

Unternehmen sollten KI-gestützte Sicherheitsprüfung nicht ignorieren, aber nur kontrolliert einsetzen: in isolierten Testumgebungen, mit klaren Berechtigungen, menschlicher Freigabe und definierten Regeln für Schwachstellenmeldungen. Der Nutzen liegt darin, eigene Systeme früher zu prüfen und Sicherheitsteams bei Triage und Analyse zu entlasten.

Lieferanten stärker prüfen

Bei proprietären Produkten müssen Sicherheitsnachweise wichtiger werden: klare Patch-Zusagen, dokumentierte Offenlegungsprozesse, Penetrationstests und vertragliche Reaktionszeiten. KI-beschleunigte Schwachstellensuche erhöht den Druck auf Lieferanten, Sicherheit nicht nur zu behaupten, sondern belegbar zu machen.

Besondere Risiken nach Branche

Für Banken und Finanzdienstleister ist Mythos vor allem ein Vertrauensrisiko. Wenn zentrale Zahlungs-, Handels- oder Kontosysteme schneller angreifbar wirken, steigt der Druck auf Aufsicht, Vorstand und Sicherheitsverantwortliche, auch wenn die eigene IT-Abteilung stark aufgestellt ist.

Kliniken und Gesundheitsdienstleister haben oft heterogene IT-Landschaften mit Systemen, die schwer zu patchen sind, weil sie mit medizinischen Geräten oder Laborprozessen verbunden sind. Hier ist die Gefahr besonders konkret: Ein Sicherheitsvorfall kann nicht nur Daten betreffen, sondern Behandlungen verzögern und Notfallprozesse belasten.

Industrie und Energie betreiben oft langlebige Systeme, die nicht für schnelle Updates oder moderne Angriffsszenarien entwickelt wurden. KI-gestützte Schwachstellensuche erhöht hier den Druck auf Segmentierung, Monitoring und die konsequente Trennung von IT- und OT-Umgebungen.

Die politische Dimension von Claude Mythos Preview

Claude Mythos ist ein Governance-Thema. Wenn wenige private Unternehmen Modelle kontrollieren, die Schwachstellen in globaler Infrastruktur schneller finden können als viele Staaten oder Unternehmen, entsteht eine neue Form sicherheitspolitischer Macht. Wer erhält Zugriff? Wer prüft die Nutzung? Wer entscheidet, welche Schwachstellen zuerst bearbeitet werden?

Aktuelle Berichte zeigen, dass politische Entscheidungsträger in den USA bereits über Sicherheitsprüfungen und Aufsicht für besonders riskante KI-Modelle diskutieren – ausdrücklich mit Blick auf Modelle mit möglichen Cyberfähigkeiten. Mythos entfaltet damit bereits über die Fachwelt hinaus politische Wirkung.

Alarm ist berechtigt, Panik nicht

Claude Mythos ist kein Beweis dafür, dass jede Software ab sofort kompromittierbar ist. Das Modell hat Grenzen, benötigt Kontext und Werkzeuge und arbeitet in Testumgebungen nicht immer erfolgreich. Gute Architektur, Segmentierung und Zugriffskontrollen erschweren Angriffe weiterhin.

Trotzdem steht Mythos für eine Entwicklung, die nicht mehr aufzuhalten ist. KI-Systeme werden besser darin, Code zu verstehen, Schwachstellen zu finden und komplexe Aufgaben zu verfolgen. Die Kosten für Sicherheitsanalyse sinken. Die Geschwindigkeit steigt und die Zahl potenzieller Akteure wächst.

Für Unternehmen ist das eine Warnung und eine Chance zugleich: Wer jetzt Inventar, Patch-Management, Segmentierung, Monitoring und kontrollierte KI-Nutzung stärkt, kann von der Entwicklung profitieren. Wer auf alte Sicherheitszyklen vertraut, riskiert, von der Beschleunigung überholt zu werden.

FAQ

Claude Mythos Preview ist ein nicht allgemein freigegebenes KI-Modell von Anthropic, das besonders starke Fähigkeiten bei der Analyse von Code und bei Aufgaben der Cybersicherheit zeigt.

Claude Mythos gilt als gefährlich, weil es die Suche nach unbekannten Sicherheitslücken beschleunigen und in bestimmten Fällen die Entwicklung mehrstufiger Angriffspfade unterstützen kann.

Nein. Anthropic beschreibt Claude Mythos Preview als Modell mit eingeschränktem Zugang. Im Rahmen von Project Glasswing erhalten ausgewählte Partner Zugang für defensive Sicherheitsarbeit.

Anthropic berichtet, dass Mythos Preview in Tests reale Schwachstellen in wichtiger Software gefunden hat. Konkrete technische Details werden teilweise nicht veröffentlicht, weil betroffene Systeme noch geschützt werden müssen.

Unternehmen müssen mit kürzeren Reaktionszeiten rechnen. Wichtiger werden Software-Inventare, schnelle Patch-Prozesse, kontrollierte Sicherheitstests, Segmentierung, Least Privilege und klare Lieferantenanforderungen.

Ja. Der defensive Nutzen liegt darin, Schwachstellen früher zu erkennen, kritische Software gezielter zu prüfen und Sicherheitsteams bei Analyse und Priorisierung zu unterstützen.

Bildnachweis: © Saulo Ferreira Angelo / Shutterstock.com

Aktuellste Artikel

Claude Mythos Preview: Risiko für die Cybersicherheit?

Reddit Ads: Wie Werbung auf Reddit funktioniert und wann sie sich lohnt

Klickbetrug bei Google Ads: Erkennen, beheben, schützen