Die Eule sieht alles, jagt lautlos und ist weise

Diese Qualitätsoffensive nennt sich „Project Owl“. Und Eulen sind ja, wie man aus Fabel und Wissenschaft weiß, weise Tiere mit ziemlich scharfen Augen (und einer beinahe lautlosen Flugtechnik). Generell ist eine solche Offensive an und für sich nichts Schlechtes. Aber verhindert man damit wirklich das Spreading von Fake-News? Und: Wie genau definiert Google die einzelnen o. g. Begriffe? Funktioniert Google wirklich als News-Gatekeeper? Genau hier holt Google jetzt seine Nutzer ins Boot. Man erlaubt diesen von nun an, die von der Suchmaschine angezeigten Inhalte per direktem Feedback an Google zu melden.

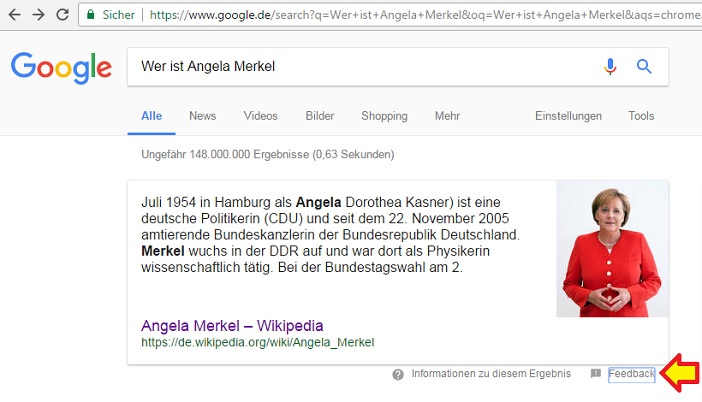

Wie funktioniert der Feedback-Button?

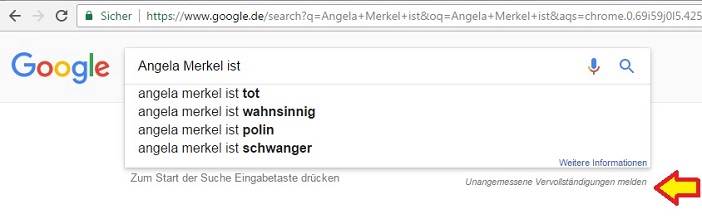

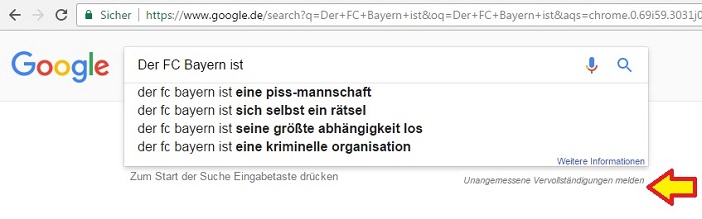

Und diese Funktion gilt sowohl für die automatische Vervollständigung, also die von Google vorgeschlagenen Ergänzungen während der Eingabe von Suchbegriffen, als auch für die meist bei einer genauen Fragestellung seit Neuestem angezeigten Featured Snippets/hervorgehobenen Snippets.

In Deutschland funktioniert der Feedback-Button für Featured Snippets wie auch für die „vorgeschlagenen Ergänzung“ seit etwa dem 27.04.2017.

5 Mal schlecht und 1 Mal gut: Google vs. Fake-News

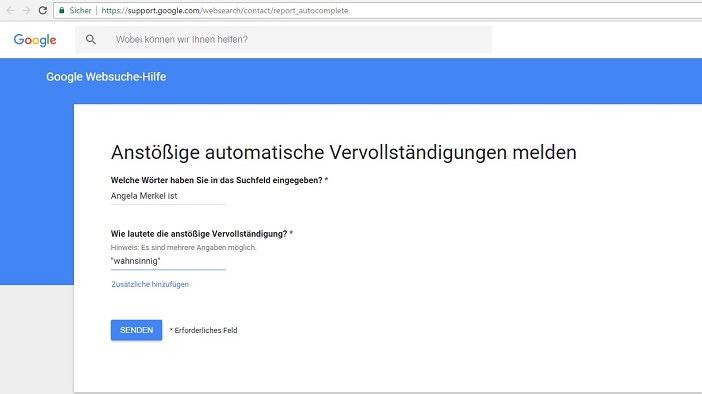

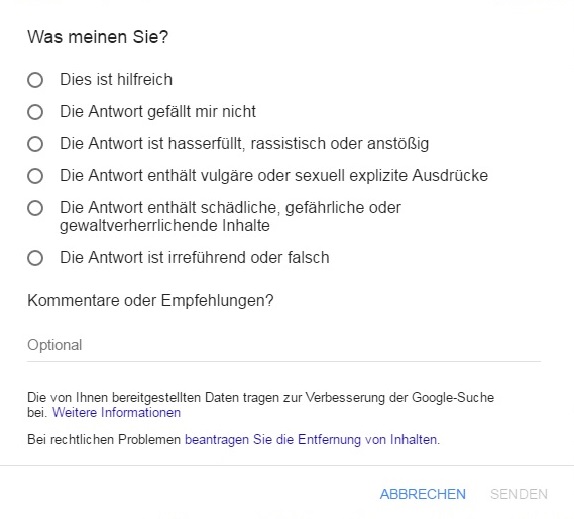

Aber betrachten wir doch kurz das Formular zum Ausfüllen, das bei den Featured Snippets zum Einsatz kommt.

Auffällig: Es ist nur eine Möglichkeit vorhanden, positives Feedback zu geben. Die restlichen Auswahlmöglichkeiten widmen sich negativen Gesichtspunkten und teilen sich in fünf unterschiedliche Kritikpunkte ein. Von einem negativen facebookesken „Gefällt mir nicht“ bis hin zu etwas wenig deutlicher definierten Meinungsäußerungen wie: Die Antwort ist hasserfüllt, rassistisch, anstößig, enthält vulgäre, sexuell explizite Ausdrücke, schädliche, gefährliche oder gewaltverherrlichende Inhalte oder ist einfach irreführend oder falsch.

Das klingt ja alles ganz nett, ABER …

Hier ist man wieder bei einem Grundproblem der Onlinewelt von Facebook bis Google. Denn wie genau definiert der Suchmaschinengigant die einzelnen Adjektive? Ab wann ist eine Aussage „hasserfüllt“ oder „anstößig“? Der Begriff „rassistisch“ hingegen ist relativ gut allgemein definiert. Aber wo fangen vulgäre Ausdrücke an? Welche Ausdrücke sind per Google-Definition sexuell explizit oder gewaltverherrlichend? Oder wie sieht es mit (Fall-)Beispielen zu den Wörtern „gefährlich“ oder „schädlich“ aus? Was dem einen schadet, muss ja nicht immer für alle schädlich sein? Und wo beginnt „Gefahr“?

Ein Gedankenspiel: Wenn man sich den letzten Punkt „Die Antwort ist irreführend oder falsch“ anschaut, stellt sich die Frage: Melden sich jetzt bei Google etwa die Menschenmassen, die von der Lügenpresse schwadronieren oder Schilder schwenkend Politiker anpöbeln, um ihnen unangenehme Featured Snippets negativ zu bewerten? Und wie reagiert Google in seiner neuen Gatekeeper-Rolle darauf? Zählt der Algorithmus die einzelnen Treffer in jeder Kritik-Kategorie? Oder gibt es einen Counter, der das Verhältnis zwischen Lob und Kritik aufzeigt und dementsprechend die Seiten positiv oder negativ bewertet.

Seitenbewertung: User und Experten helfen dem Algorithmus

Ganz richtig gehört: Das Feedback der Google-Search-Nutzer soll in die Rankings der Seiten eingehen. Wie Ben Gomes erklärt, soll „dieses Feedback in die Verbesserung unserer Algorithmen einfließen.“ In der Praxis würde das bedeuten, dass ein im Featured Snippet genannter Link seine Position als Featured Snippet verliert. Außerdem müsste die Seite, auf die verlinkt wird, dann auch in den generellen Search-Rankings abgestuft werden.

Aber wie viel negative Kritiken ergeben eine Abstufung? Und wie evaluiert Google, bevor abgestuft wird, ob die geäußerte Kritik berechtigt ist? Zu diesen Prozessen steht leider nichts Genaues im Blogbeitrag von Ben Gomes. Dennoch verweist er im Bezug auf die Suchrankings auch darauf, dass man dort „ Feedback von Prüfern“ erhalte. Zusätzlich spricht er von „realen Personen, die die Qualität der Suchergebnisse von Google unter die Lupe nehmen.“ Allerdings habe „dieses Feedback keinen unmittelbaren Einfluss auf das Ranking eigener Seiten, […] helfe uns jedoch dabei, Daten zur Qualität unserer Suchergebnisse zu sammeln und Bereiche mit Verbesserungsbedarf zu erkennen.“

Das Fazit zu Google vs. Fake-News: Wahrheit oder Nicht?

Googles Kampf gegen Fake-News ist gut und schlecht gleichzeitig. Gut ist, dass sich der Konzern endlich offensiv gegen Fake-News wendet und im dritten, noch nicht genannten Punkt von „Projekt Eule“ auch dazu bekennt, offener im Bezug auf seine Produkte zu werden. Wobei der Begriff „offener“ impliziert, Google sei bisher schon „offen“ gewesen. Ebenfalls ist es nun einfacher möglich, gegen ehrabschneidende Ergänzungen in der automatischen Ergänzung vorzugehen.

Negativ ist aus meiner Sicht, dass Google im Feedback-Dokument zum großen Teil schwammige Kriterien angibt. Es wird leider nicht an Hand von Beispielen definiert, welche Inhalte darunter fallen. Zusätzlich stellt sich die Frage, wessen Moralvorstellungen bestimmen, was vulgär ist und was nicht? Man muss sich ja nur einmal die Bilder anschauen, die z. B. auf Instagram wegen vulgärer Inhalte entfernt wurden oder die Diskussion verfolgen, ob und wer Brustwarzen auf Facebook zeigen darf. Außerdem ist die Frage, ob man Verbreitern von Fake-News mit dem Feedback-Tool nicht auch ein Werkzeug an die Hand gibt, die eigenen fragwürdigen Inhalte durch positives Feedback stärker zu pushen bzw. eigentlich korrekte Angaben in den Featured Snippest durch schlechte Bewertungen zu verdrängen.

Wir auch, schreit Facebook! Ein kurzer Nachtrag

Wenn Google, voranschreitet, dann muss Facebook nachziehen und vice versa: Da verwundert es nicht, dass sich nur zwei Tage nach Google Facebook meldet und ankündigt, man werde stärker gegen Fake-News vorgehen. Hier stehen auch User im Fokus, allerdings nicht echte, sondern gefakte User(profile), wie der Bericht „Information Operations an Facebook“ vom 27. April zeigt. Facebooks Waffen der Wahl im Einsatz gegen Fake-Konten: Intelligente Software und eine verstärkte Datenanalyse. Im Rahmen der Wahl in Frankreich habe man so mehr als 30.000 verdächtige Fake-Accounts gelöscht.