Wer 2026 noch über SEO spricht, als ginge es primär um Rankings und Klickpfade, beschreibt nur noch einen Teil des Systems. Die eigentliche Veränderung passiert eine Ebene tiefer. Google baut mit dem AI Mode eine Such- und Browsererfahrung, in der Recherche, Auswertung und Anschlussfragen nicht mehr in getrennten Schritten ablaufen. Parallel entsteht mit WebMCP ein technischer Ansatz, der Websites für KI-Agenten nicht nur lesbar, sondern bedienbar macht. Diese Kombination markiert den Übergang von klassischer Suche zu agentischer Webinteraktion.

Für Websitebetreiber bedeutet das eine reale strategische Chance auf drei Ebenen: bessere Einbindung in KI-gestützte Retrieval-Prozesse, weniger Reibung in agentischen Journeys und mehr Kontrolle über maschinelle Nutzung durch strukturierte Tooloberflächen.

Das alte Modell bricht auf

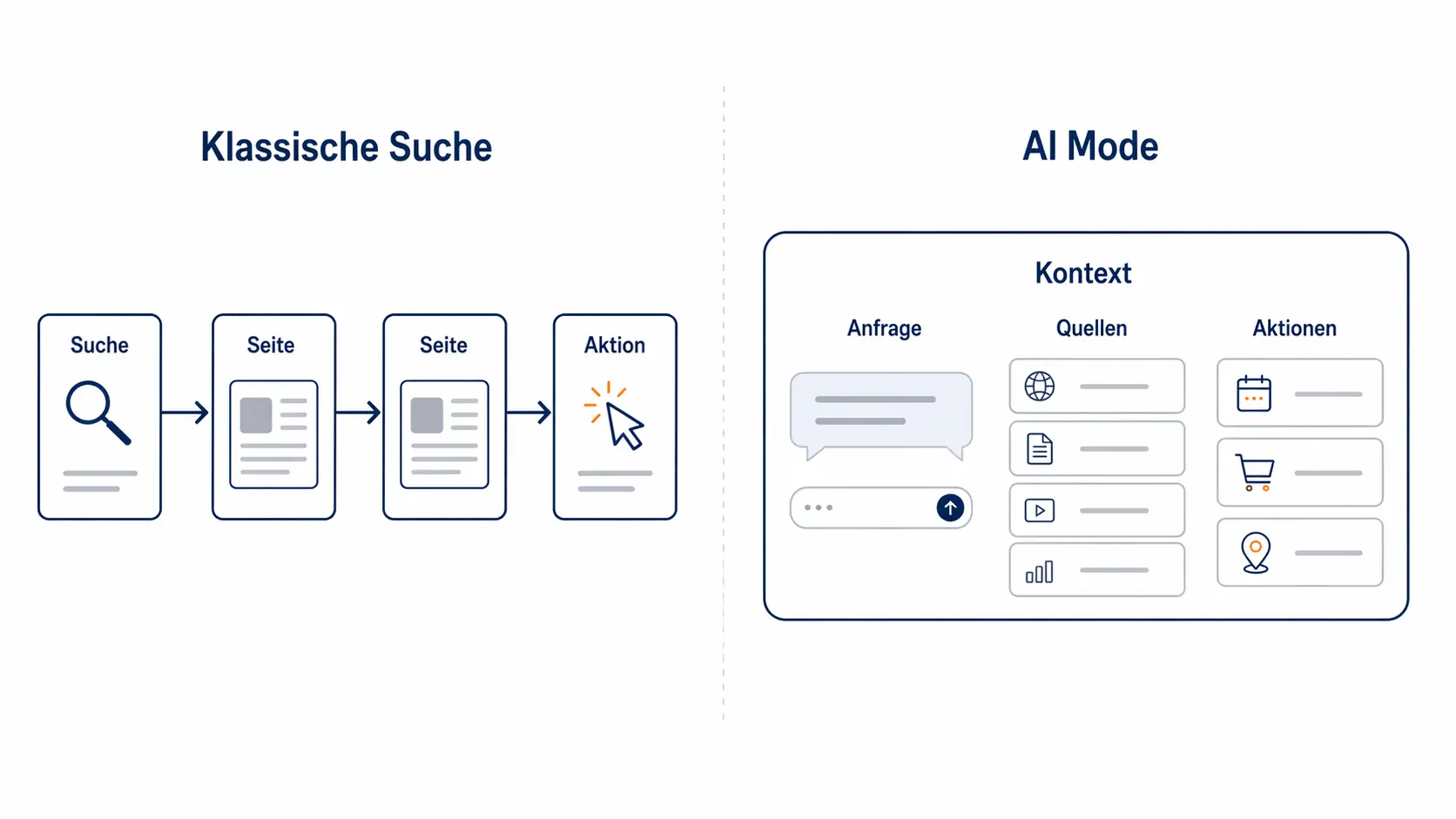

Bisher war das Web im Kern dokumentenzentriert. Ein Mensch stellt eine Anfrage, bekommt Verweise, öffnet Seiten, vergleicht Informationen und führt danach manuell eine Aktion aus. Dieses Modell hat jahrzehntelang funktioniert. Jetzt bricht es auf.

Im entstehenden Modell bleibt der Nutzer eingebunden, aber die operative Schicht verschiebt sich. Browser und KI-Systeme übernehmen zunehmend die Schritte dazwischen: Recherche zusammenführen, Optionen abwägen, Kontexte verknüpfen. Der Mensch gibt die Richtung vor, der Agent erledigt die Navigation.

Google beschreibt den AI Mode als Sucherfahrung für komplexe, mehrteilige Fragen, mit Folgedialogen, multimodaler Eingabe und tieferem Informationsabruf. Der W3C-Community-Group-Entwurf zu WebMCP beschreibt parallel eine API, mit der Webanwendungen ihre Funktionalität als JavaScript-basierte Tools für AI Agents bereitstellen können. Zusammen ergeben beide Entwicklungen eine neue Maschinenebene des Webs.

Wie Google AI Mode Suchanfragen verarbeitet

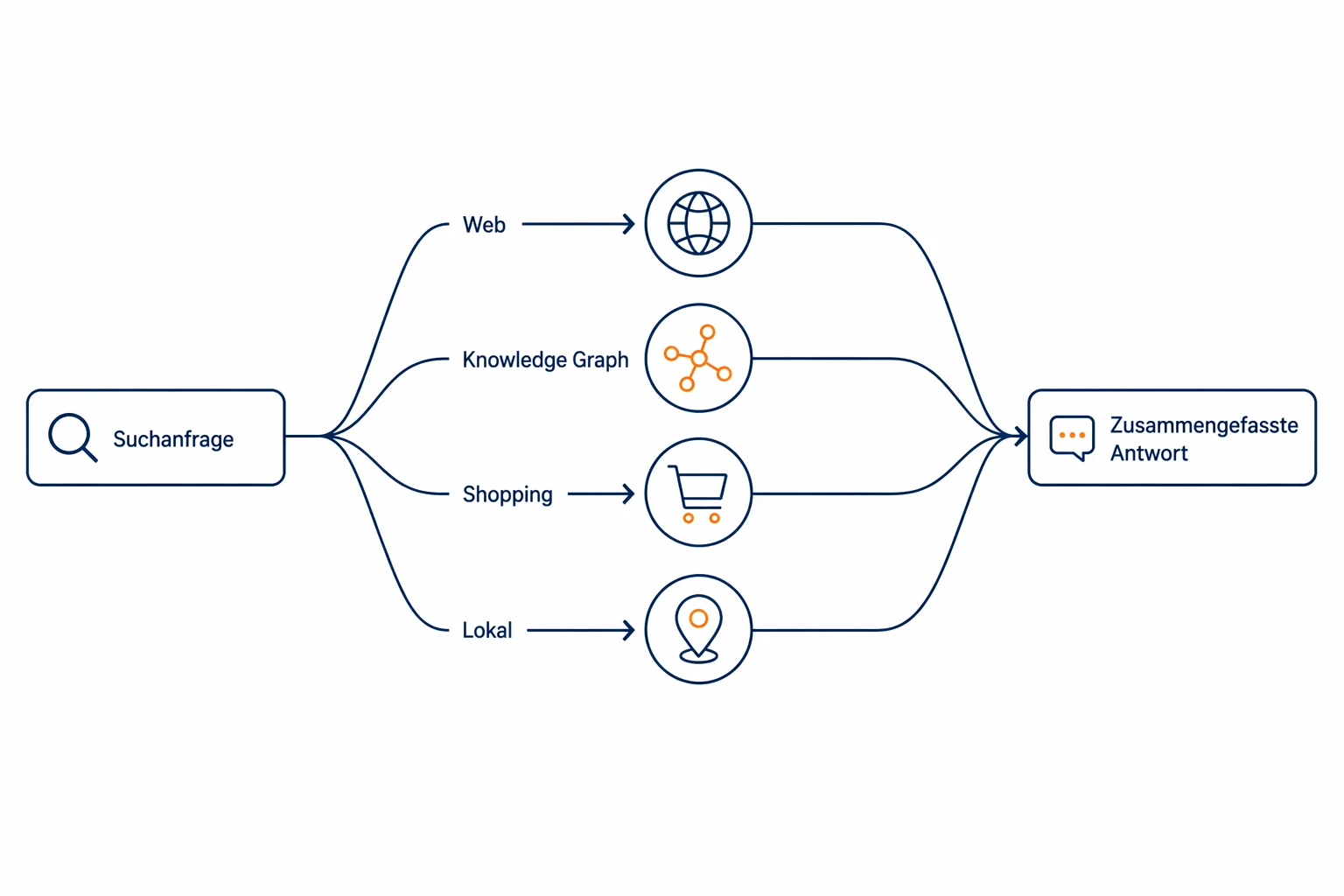

Der Schlüsselbegriff ist Query Fan Out. Statt eine Anfrage linear zu beantworten, zerlegt das System sie in verwandte Teilfragen, durchsucht mehrere Datenquellen parallel und fügt die Ergebnisse zu einer zusammenhängenden Antwort zusammen. Google kombiniert dabei Webinhalte mit anderen Informationssystemen wie dem Knowledge Graph und Shopping-Daten.

Damit entwickelt sich der Retrieval Layer von einer Ergebnisliste zu einem orchestrierten Abfragegraphen. Eine Suchanfrage startet jetzt einen Planungs- und Syntheseprozess. Sichtbar ist künftig nicht mehr nur, wer auf ein Keyword rankt, sondern wer über Teilfragen, Entitäten und Produktsignale hinweg verlässlich wiederverwendbar ist.

In Chrome wird das noch greifbarer. Mit den April-2026-Updates öffnet sich eine angeklickte Quelle neben dem laufenden AI Mode, statt in einem neuen Tab. Der Dialog bleibt erhalten, während die Quelle parallel sichtbar ist. Über ein neues Plus-Menü lassen sich zusätzlich aktuelle Tabs, Bilder und PDFs direkt in den AI Mode einbringen. Der Browser selbst wird zum Kontextcontainer für die KI.

Im klassischen Modell war jeder Seitenaufruf ein Kontextbruch: verlassen, orientieren, zurückspringen, neu formulieren. Mit der Side-by-Side-Darstellung fällt dieser Bruch weitgehend weg. Eine Website ist künftig öfter nicht mehr der Endpunkt einer Journey, sondern ein laufendes Element im Denkraum der KI.

Seit Anfang 2026 ist Gemini 3 das Standardmodell für AI Overviews. Google beschreibt den Übergang zwischen AI Overview und AI Mode als fließende Erfahrung: schnelle Zusammenfassung, dann nahtlose Konversation mit erhaltenem Kontext. Mit der optionalen Verbindung persönlicher Datenquellen wie Gmail und Google Photos wird deutlich, dass AI Mode eine Assistenzschicht ist, die Web, persönliche Daten, Shopping und produktive Workflows zusammenführt.

Wie sich Content und Sichtbarkeit dadurch verändern

Viele Diskussionen über den AI Mode kreisen um die Frage, ob dadurch Klicks verloren gehen. Die Frage ist berechtigt, aber sie greift zu kurz.

Dokumente wandeln sich von abgeschlossenen Landing Pages zu modularen Wissensquellen. Gut funktioniert, was klar definierte Entitäten, präzise Fachbegriffe, belastbare Definitionen, nachvollziehbare Vergleiche und erkennbare Aktualität liefert. Genau solche Inhalte lassen sich in einem Query-Fan-Out-Prozess leichter in Teilantworten und Folgefragen integrieren. Unklare Marketingtexte, semantisch dünne Ratgeber und Seiten, die primär auf Conversion-Widgets setzen, werden in diesem Setup weniger verwendet, weil ein KI-System mit ihnen wenig anfangen kann.

Das verändert auch, wie man E-E-A-T denken sollte. Im klassischen Ranking helfen Erfahrung, Expertise, Autorität und Vertrauenswürdigkeit dabei, als gute Quelle im Index zu gelten. Im AI Mode müssen Inhalte zusätzlich als zitatfähige, extrahierbare Bausteine funktionieren. Wer technische Sachverhalte präzise definiert, Gegenargumente klar abgrenzt und Aktualität sichtbar macht, erhöht die Chance, in eine KI-Antwort eingebunden zu werden, ohne dabei semantisch zu verflachen. Wichtig dabei: Google gibt in seiner Search-Central-Dokumentation ausdrücklich an, dass es keine zusätzlichen technischen Anforderungen gibt, um in AI Overviews oder AI Mode als Quelle zu erscheinen. WebMCP ist kein Ranking-Faktor für AI Mode, sondern eine eigenständige Infrastruktur für agentische Bedienbarkeit. Beides zusammen ergibt aber eine deutlich stärkere Position.

WebMCP: die fehlende Infrastrukturschicht

Hier kommt WebMCP ins Spiel. Die Web Machine Learning Community Group definiert WebMCP als API, mit der Webanwendungen JavaScript-basierte Tools für AI Agents bereitstellen können. Die Spezifikation ist noch kein W3C-Standard und steht ausdrücklich nicht auf dem Standards Track. Im Umfeld von Google, Microsoft und der W3C Community Group wird das Thema aber sichtbar vorangetrieben, Browser-Prototypen existieren, und seit Februar 2026 ist WebMCP als Early Preview für Prototyping in Chrome verfügbar.

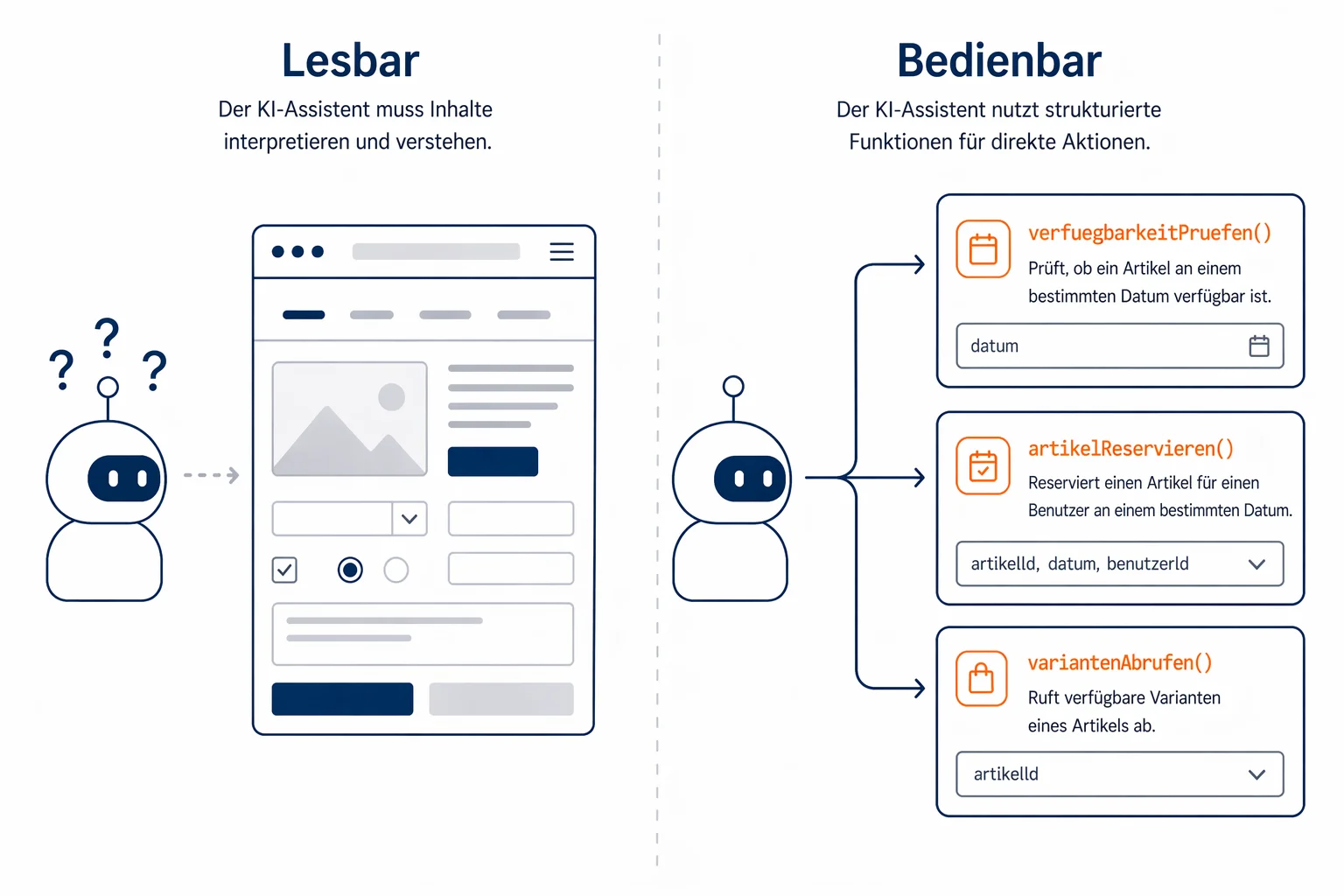

Das Web wurde für Menschen gebaut. HTML beschreibt Inhalte so, dass Browser sie rendern und Menschen sie bedienen können. KI-Agenten müssen sich in diesem Modell mühsam orientieren. Sie lesen DOM-Strukturen, Buttontexte und Formulare ähnlich wie Screen Scraping, und scheitern entsprechend oft an kleinen Layout-Änderungen. WebMCP löst das strukturell: Websites können ihre Fähigkeiten als explizite Tools mit klarer Beschreibung und Eingabeschema bereitstellen.

Der Unterschied zwischen lesbar und bedienbar ist dabei entscheidend. Eine lesbare Seite lässt sich von einer KI analysieren. Eine bedienbare Seite lässt sich von einer KI verlässlich nutzen. Wenn eine Produktseite ihre Varianten, Verfügbarkeit und Reservierungsfunktion als definierte Tools anbietet, muss ein Agent nicht mehr raten, welcher Button was tut. Er ruft eine Funktion mit einem klaren Eingabeschema auf.

Chrome beschreibt in seiner Early-Preview-Ankündigung, wie das konkret aussieht: Nutzer ermöglichen einem Agenten, Flüge zu suchen, Ergebnisse zu filtern und Buchungen mit strukturierten Daten abzuwickeln. Das zeigt, wohin die Reise geht: weniger fehleranfällige, deterministischere Interaktion für agentische Workflows.

Konzeptionell lassen sich Websites mit WebMCP wie MCP Server denken, die Tools clientseitig in JavaScript implementieren, statt sie im Backend zu betreiben. Das macht WebMCP besonders interessant für Websites, die Aktionen im sichtbaren Frontend verankern wollen, statt rein API-getriebene Integrationen zu bauen.

Die Chance für Websitebetreiber

Die eigentliche Chance liegt nicht darin, dass Websites plötzlich von Bots besucht werden. Das tun sie längst. Neu ist, dass erstmals ein offenerer, standardisierter Weg entsteht, auf dem Websites ihre Funktionen so beschreiben können, dass Agenten sie zielgerichtet nutzen. Eine Website agiert damit nicht mehr als passive Informationsquelle, sondern als aktiver Bestandteil maschineller Entscheidungsketten.

Ein konkretes Bild: In der klassischen Customer Journey eines Shops sucht der Nutzer, filtert, prüft Varianten, liest Bewertungen und checkt Verfügbarkeit. Im AI Mode lässt sich ein Teil dieser Reise bereits in der Browser- und Suchumgebung vorbereiten. Wenn die Zielwebsite zusätzlich WebMCP-fähige Funktionen anbietet, sinkt die Reibung weiter: Der Agent greift direkt auf strukturierte Produktmerkmale, Filteroptionen und Lagerdaten zu, statt sie aus HTML zu rekonstruieren. Dass Google im AI Mode bereits agentische Shopping-Fähigkeiten wie lokale Bestandsprüfungen und Reservierungen hervorhebt, macht diesen Use Case besonders plausibel.

Lehrreich ist hier Microsofts Learn MCP Server. Microsoft beschreibt ihn als Remote-MCP-Server, der vertrauenswürdige und aktuelle Informationen direkt aus der offiziellen Dokumentation an Clients wie GitHub Copilot und andere AI Agents liefert. Der Engineering Blog macht dabei einen wichtigen Punkt: Die Tooloberfläche sollte nicht einfach die interne API spiegeln, sondern dem natürlichen Arbeitsstil von Agenten folgen. Statt die interne Komplexität zu exportieren, wurden zwei intuitive Operationen, Search und Fetch, entlang des Such- und Leseverhaltens von LLM-Agents modelliert. Das ist die richtige Denkrichtung für alle, die agentische Interfaces bauen wollen.

Sicherheit ist kein Randthema

Je stärker Websites für Agenten bedienbar werden, desto wichtiger werden Sicherheits- und Governance-Fragen. OWASP behandelt agentische Anwendungen in den Top 10 for Agentic Applications bereits als reale Angriffsoberfläche und priorisiert Risiken wie unautorisierte Aktionen, Kontextmanipulation und missverständliche Tooldefinitionen. Das ist für alle, die WebMCP-Interfaces planen, direkte Pflichtlektüre.

Microsofts Learn MCP Server zeigt, dass Remote-MCP-Server wie verteilte Systeme behandelt werden müssen, mit Cross-Region-Deployment, CORS, Session Affinity und Datenschutz. Cloudflare empfiehlt in seiner Referenzarchitektur Remote-MCP-Server mit Zugangskontrolle und Gateway Governance. Wer agentische Interfaces baut, darf also nicht nur an Nutzbarkeit denken. Governance, Authentifizierung, Monitoring und eine bewusst begrenzte Tooloberfläche gehören von Anfang an zur Architektur.

Was jetzt konkret zu tun ist

WebMCP wirkt dort stark, wo bereits saubere Objekte, Prozesse und Zustände vorhanden sind. Chaotische Informationsarchitektur lässt sich damit nicht im Nachhinein reparieren. Der sinnvollste Einstieg ist deshalb ein strukturierter Vorlauf.

Zunächst sollte geklärt werden, welche Inhalte und Funktionen der eigenen Website überhaupt agentenrelevant sind. Bei einem B2B-SaaS-Anbieter können das Konfigurationen oder Preislogiken sein, bei einem Medienhaus strukturierter Zugriff auf Archiv, Themenhubs und Aktualisierungsstände, bei E-Commerce Produktattribute, Variantenlogik und Servicebedingungen.

Dann lohnt es sich, die eigenen Kernjourneys daraufhin zu analysieren, wo KI-Systeme am meisten Reibung hätten. Müssen sie Produktoptionen aus unstrukturierten Tabellen herauslesen, Supportwege erraten oder Buchungslogik über mehrstufige Formulare erschließen, ist das ein klares Signal für strukturellen Nachholbedarf.

Im nächsten Schritt lohnt sich ein Proof of Concept für agentenrelevante Funktionen. Nicht gleich vollständige Automatisierung, sondern kontrollierte Exposition sinnvoller Werkzeuge. Die Microsoft-Learn-Architektur zeigt: oft liefern wenige gut modellierte Tooloperationen mehr Wert als ein riesiger, ungefilterter Funktionskatalog.

Parallel sollte die Contentstrategie weiterentwickelt werden. AI Mode bevorzugt Quellen, die in komplexen Retrieval- und Antwortketten belastbar funktionieren: Inhalte mit klaren Definitionen, nachvollziehbaren Vergleichen, aktualisierten Daten, fachlicher Einordnung und erkennbarer Autorenschaft. In vielen Unternehmen liegt genau hier die eigentliche Lücke. Man diskutiert über KI-Sichtbarkeit, während die Inhalte weder für Menschen noch für Maschinen präzise genug aufbereitet sind. Der Weg zu besserer KI-Präsenz führt also auch über bessere Fachlichkeit.

Übersicht: AI Mode und WebMCP im Vergleich

Die wichtigsten Unterschiede zwischen beiden Konzepten auf einen Blick:

| AI Mode | WebMCP | |

| Was es ist | Konversationelle Suchoberfläche in Google/Chrome | Browser-native API für agentische Toolbereitstellung |

| Wer es entwickelt | Google + Microsoft, im Umfeld der W3C Community Group | |

| Status | Ausgerollt (USA), April 2026 in Chrome erweitert | Draft Community Group Report, Early Preview Chrome 146 |

| Was es verändert | Wie Nutzer suchen und Kontext aufbauen | Wie Websites von KI-Agenten bedient werden können |

| Relevant für | Content-Strategie, E-E-A-T, Sichtbarkeit | Technische Architektur, Frontend-Struktur, APIs |

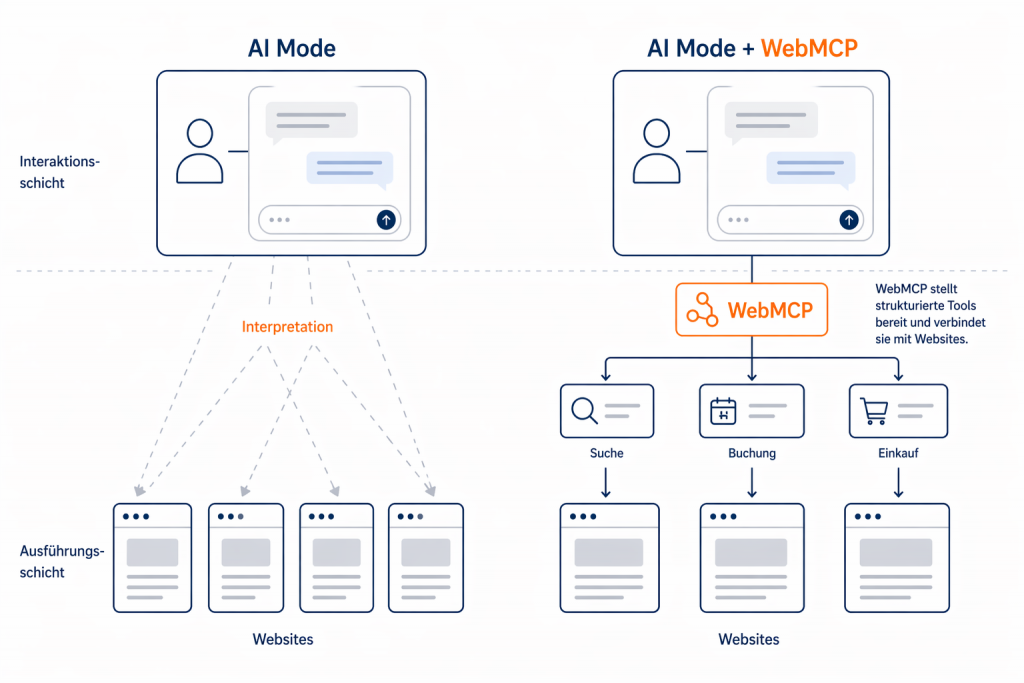

| Zusammenhang | Interaktionsschicht | Infrastrukturschicht |

Wer jetzt strukturiert, gewinnt später

AI Mode und WebMCP gehören in dieselbe Debatte, weil sie zwei Seiten derselben Umstellung markieren. AI Mode verändert, wie Nutzer suchen, lesen, vergleichen und Anschlussfragen stellen. WebMCP verändert, wie Websites in genau diesen Interaktionen erreichbar und nutzbar sind.

Das Web wird damit neu verteilt. Der Wert einzelner Websites verschiebt sich von bloßer Präsenz zu strukturierter Nutzbarkeit. Wer jetzt beginnt, Inhalte semantisch sauber zu modellieren, Funktionen agentenfreundlich zu denken und sichere Schnittstellen aufzubauen, verschafft sich einen Vorsprung in einer Phase, in der sich neue Zugangslogiken zum Web gerade erst stabilisieren.

Die entscheidende Frage lautet daher nicht mehr nur, ob eine Seite gefunden wird. Sie lautet, ob ein KI-System mit ihr sinnvoll arbeiten kann.

FAQ

Der Google AI Mode verbindet fortgeschrittene Modellfähigkeiten mit Googles Informationssystemen zu einer konversationsorientierten Such- und Browsererfahrung. Technisch zentral ist der Query-Fan-Out-Ansatz: Das System zerlegt eine Anfrage in Teilfragen, durchsucht mehrere Datenquellen parallel und fasst die Ergebnisse zu einer kohärenten Antwort zusammen. Als Quellenbasis kombiniert Google Webinhalte mit anderen Informationssystemen wie dem Knowledge Graph und Shopping-Daten. Seit Anfang 2026 ist Gemini 3 das Standardmodell für AI Overviews. Aktuelle Tabs, Bilder und Dateien lassen sich direkt in den AI Mode einbringen. Der Browser wird damit selbst zum Kontextcontainer für die KI.

Klassische Browser-Automation interpretiert Oberflächen indirekt: Ein Agent liest DOM-Strukturen, Labels und Buttontexte ähnlich wie Screen Scraping. Das ist fehleranfällig, weil schon kleine Layout-Änderungen die Automation brechen. WebMCP löst das strukturell: Websites beschreiben ihre Funktionen als explizite Tools mit definierten Eingabeschemata und natürlichsprachlicher Beschreibung. Ein Agent ruft eine Funktion gezielt auf, statt zu raten, was ein Button tut. Das macht Interaktionen deterministischer und deutlich robuster.

Die Spezifikation wurde von der Web Machine Learning Community Group veröffentlicht und steht ausdrücklich nicht auf dem W3C-Standards-Track. Seit Februar 2026 ist WebMCP als Early Preview für Prototyping in Chrome verfügbar. Für Websitebetreiber bedeutet das: Jetzt ist der richtige Zeitpunkt, Informationsarchitektur und Domainlogik so zu strukturieren, dass eine WebMCP-Integration später ohne großen Umbau möglich ist.

Nein. Google gibt in seiner Search-Central-Dokumentation ausdrücklich an, dass es keine zusätzlichen technischen Anforderungen gibt, um in AI Overviews oder AI Mode als unterstützender Link zu erscheinen. WebMCP und AI-Mode-Sichtbarkeit sind zwei verschiedene Dinge. WebMCP verbessert die agentische Bedienbarkeit einer Website, nicht ihre Eligibility für Googles AI Features. Wer beides optimiert, hat aber die stärkste Position.

Websites liefern damit nicht nur Inhalte, sondern stellen in agentischen Nutzerflüssen Funktionen bereit. Ein Shop, der Produktvarianten, Verfügbarkeit und Reservierungslogik als strukturierte Tools anbietet, hat gegenüber einem Wettbewerber, der das nicht tut, einen messbaren Vorteil, sobald ein KI-Agent die erste Recherche- und Entscheidungsebene übernimmt.

E-E-A-T bleibt relevant, bekommt aber eine neue Dimension. Im klassischen Ranking helfen Erfahrung, Expertise, Autorität und Vertrauenswürdigkeit dabei, als gute Quelle zu gelten. Im AI Mode müssen Inhalte zusätzlich als zitatfähige, extrahierbare Bausteine funktionieren. Wer Sachverhalte präzise definiert, Gegenargumente klar abgrenzt und Aktualität erkennbar macht, erhöht die Chance, in KI-Antworten eingebunden zu werden, ohne semantisch zu verflachen. SEO entwickelt sich damit von reiner Auffindbarkeit hin zu maschinenfreundlicher Verwendbarkeit.

OWASP priorisiert in den Top 10 for Agentic Applications Risiken wie unautorisierte Aktionen, Kontextmanipulation und missverständliche Tooldefinitionen. Wer Websites für Agenten operierbar macht, schafft neue Angriffsflächen, die von Anfang an mitgedacht werden müssen. Governance, Authentifizierung, Monitoring und eine bewusst begrenzte Tooloberfläche gehören zur Architektur, nicht als Nacharbeit.

AI Mode ist die Interaktionsschicht: Nutzer stellen komplexe Fragen, führen Folgedialoge und bringen Kontext aus Tabs, Dateien und persönlichen Datenquellen ein. WebMCP ist die Infrastrukturschicht: Websites werden in genau diesen Umgebungen zu funktionalen Gegenstellen, nicht nur zu Informationsträgern. Ohne WebMCP bleibt der Agent auf Interpretation angewiesen, mit WebMCP ruft er Funktionen, Zustände und Schemata gezielt ab. Beide Entwicklungen beschleunigen sich gegenseitig.

Aktuellste Artikel

Lovable SSR 2026: Das bedeutet der Stack-Wechsel für SEO

Agentische Suche: WebMCP, Gemini in Chrome und AI Mode

Real User Monitoring: Vorteile, Tools, Kosten und SEO-Integration