Warum das Thema für Content-Teams und Redaktionen relevant ist

Generative KI produziert schnell große Textmengen. Das ist ihr naheliegendster Nutzen für Redaktionen und Marketingteams. Die eigentliche Herausforderung beginnt aber danach: Viele KI-Texte sind sprachlich korrekt, wirken aber seltsam distanziert. Sie beantworten keine echten Leserfragen, sie antizipieren sie nicht einmal.

Hier taucht in der Praxis der Begriff „vermenschlichen“ auf. Was damit meist gemeint ist: weniger Generik, weniger Vorhersehbarkeit, mehr Bezug auf das, was Leserinnen und Leser tatsächlich beschäftigt. Das ist eine legitime Anforderung, aber sie greift zu kurz, wenn man sie auf Stilfragen reduziert. Die interessantere Frage ist die Vertrauensfrage. Purcell, Jakesch, Dong, Nussberger und Köbis berichten 2025 in iScience über ein Experiment zu KI-gestützter Kommunikation, in dem Teilnehmende mit KI-Unterstützung ähnliche Vertrauensniveaus erreichten wie ohne bei deutlich geringerem Zeitaufwand. Die KI-unterstützten Nachrichten wurden dabei als wärmer, komplexer und sprachlich ausdrucksstärker bewertet. Das bedeutet nicht, dass KI-Texte generell vertrauenswürdiger sind. Es zeigt aber: KI-gestütztes Schreiben beschädigt Vertrauen nicht automatisch, wenn das Kommunikationssetting darauf ausgelegt ist.

Was „KI-Texte vermenschlichen“ konkret bedeuten kann

Der Begriff klingt griffig, bleibt aber oft unscharf. Hilfreich ist, ihn in beobachtbare Elemente zu zerlegen.

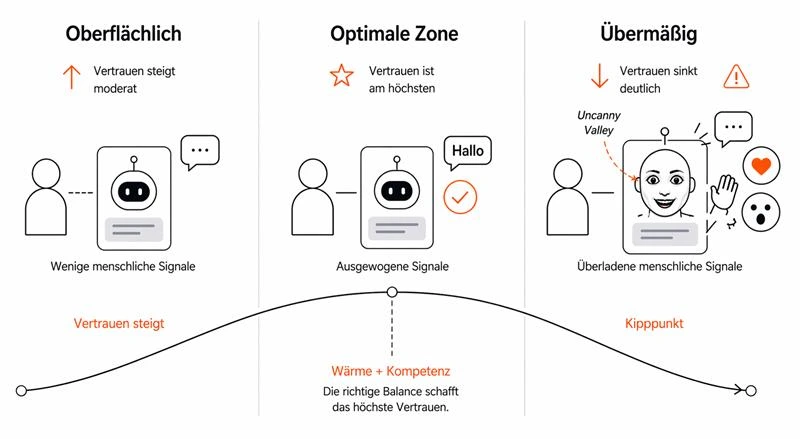

Shi, Niu, Jin, Yang und Sun untersuchten 2025 im International Journal of Human-Computer Studies das Vertrauen in virtuelle Agenten. In drei Studien manipulierten sie verhaltensbezogenen Anthropomorphismus, unter anderem über den Einsatz von Emoticons. Ihr zentrales Ergebnis: Verhaltensbezogener Anthropomorphismus erhöhte das Vertrauen in KI, vermittelt über die Wahrnehmung von Wärme und Kompetenz. Zugleich benennen die Autoren eine klare Grenze: Wenn verhaltensbezogener und visueller Anthropomorphismus gleichzeitig stark ausgeprägt sind, kann der Effekt durch einen Uncanny-Valley-Mechanismus kippen und Vertrauen aktiv beschädigen.

Für redaktionelle Texte lässt sich daraus keine direkte Stilregel ableiten. Shi et al. untersuchten virtuelle Agenten, nicht Blogartikel. Aber eine brauchbare Arbeitshypothese ergibt sich trotzdem: Menschlicher wirkende Kommunikation entsteht nicht über Lockerheit allein, sondern über Signale, die als Wärme und Kompetenz gelesen werden.

- Wärme entsteht im Text durch Adressatenbezug, nachvollziehbare Anschlussstellen und erkennbare Kommunikationsabsicht.

- Kompetenz entsteht durch Präzision, klare Begriffsführung, korrekt eingegrenzte Aussagen und belastbare Belege.

Für wissenschaftsnahe Marketingtexte ist genau diese Verbindung entscheidend.

Warum Tarnung der falsche Fokus ist

Viele Praxistexte behandeln das Thema, als ginge es vor allem darum, KI-Texte unkenntlich zu machen. Aus wissenschaftlicher Sicht ist das aus zwei Gründen der falsche Ansatz.

Erstens: KI-Beteiligung führt nicht automatisch zu Vertrauensverlust. Purcell et al. fanden 2025 in ihrem experimentellen Design keine signifikante Senkung des Vertrauensniveaus durch die Offenlegung von KI-Nutzung. Die Autoren formulieren das ausdrücklich vorsichtig und bezogen auf ihr spezifisches Setting – es ist kein Freibrief für jede Form von KI-Kommunikation. Aber der Befund widerspricht einer verbreiteten Annahme, nach der Transparenz über KI-Einsatz zwangsläufig negativ wirkt. ()

Zweitens: Die sichere Erkennung von KI-Texten ist deutlich schwieriger, als viele Tool-Anbieter nahelegen. Erol, Ergen, Gülşen Erol et al. untersuchten 2025 in Acta Neurochirurgica die Zuverlässigkeit von KI-Textdetektoren im akademischen Kontext und beschreiben relevante Genauigkeitsgrenzen sowie methodische Probleme bei der Unterscheidung zwischen menschlich und maschinell erzeugten Texten. Der Publikationsort ist dabei zu beachten: Acta Neurochirurgica ist ein neurochirurgisches Fachjournal; die Studie entstand im medizinischen Hochschulkontext und ihre Befunde lassen sich nicht ohne Weiteres auf andere Fachgebiete oder Textsorten übertragen. Neuere Analysen zu Accuracy-Bias-Trade-offs in KI-Detektionswerkzeugen zeigen zusätzlich: Solche Systeme reagieren je nach Textsorte unterschiedlich, weisen Verzerrungen gegenüber nicht-muttersprachlichen Autorinnen und Autoren auf und liefern je nach Fachgebiet abweichende Ergebnisse. Ein Detektor kann damit kein belastbares Beweismittel für oder gegen KI-Beteiligung sein.

Für Content-Teams ist deshalb redaktionelle Verantwortung der sinnvolle Zielbegriff, nicht Tarnung. Ein Text gewinnt nicht dadurch an Glaubwürdigkeit, dass seine Entstehung unsichtbar wird, sondern dadurch, dass Aussagen überprüfbar sind, Einordnung erkennbar ist und die sprachliche Oberfläche nicht den Inhalt ersetzt.

Was Studien zum Anthropomorphismus nahelegen

Beim Thema Vermenschlichung wird oft angenommen, mehr Menschlichkeit führe automatisch zu mehr Vertrauen. Genau das legen die belastbaren Arbeiten nicht nahe.

Shi et al. zeigen 2025 einen positiven Effekt von verhaltensbezogenem Anthropomorphismus in virtuellen Agenten, benennen aber zugleich klare Grenzen bei übermäßiger anthropomorpher Gestaltung.

Ein ähnliches Muster findet sich in einem anderen Anwendungsfeld: Wu, Wang und Yuen untersuchten 2022 in Computers in Human Behavior das Verhältnis von Anthropomorphismusgrad und Vertrauen in geteilte autonome Fahrzeuge. Ihr zentrales Ergebnis: Ein oberflächliches Maß an Anthropomorphismus steigerte das Vertrauen der Nutzerinnen und Nutzer, während ein tiefes Maß das Vertrauen nicht weiter erhöhte – in bestimmten demografischen Gruppen wirkte es sich sogar negativ aus. Der Kontext ist Mobilität, nicht Content-Marketing, aber gerade deshalb ist die Studie instruktiv: Anthropomorphe Gestaltung wirkt offenbar nicht linear, sondern hat Schwellen und Kipppunkte.

Für die redaktionelle Praxis heißt das: Ein KI-Text wird nicht automatisch besser, wenn er möglichst menschlich klingt. Entscheidend ist, welche Form von Menschlichkeit gemeint ist. Joviale Formulierungen, künstliche Emotionalität oder überinszenierte Dialognähe wirken schnell dekorativ. Substanzieller ist eine Form von Menschlichkeit, die sich in Perspektive, Urteilskraft, konkreten Beispielen und sauberer Unsicherheitsmarkierung zeigt.

Was das für die Überarbeitung von KI-Texten bedeutet

Ein brauchbarer KI-Entwurf ist in der Regel ein Ausgangspunkt, kein publizierfähiger Endtext. Wer einen Text „vermenschlichen“ will, sollte weniger an Synonyme denken und mehr an Erkenntnisarbeit. Für wissenschaftsnahes Schreiben sind fünf Eingriffe besonders sinnvoll:

1. Aussagen an belastbare Quellen binden

Anstelle schwammiger Aussagen wie „Studien zeigen“ empfiehlt sich, klar zu nennen, um welche Studie, welches Jahr, welches Setting, welchen konkreten Befund es sich handelt. Das verhindert unzulässige Verallgemeinerungen. Der Unterschied ist zentral: „Shi et al. 2025 fanden in Studien zu virtuellen Agenten einen positiven Effekt von verhaltensbezogenem Anthropomorphismus auf Vertrauen, vermittelt über Wärme und Kompetenz“ ist präzise. „Studien zeigen Anthropomorphismus steigert Vertrauen“ ist zu grob – und damit faktisch irreführend.

2. Befunde nur in ihrem Geltungsbereich verwenden

Purcell et al. untersuchten KI-gestützte Kommunikation in einem spezifischen experimentellen Setting. Erol et al. untersuchten Detektoren im akademischen Kontext. Wu et al. beziehen sich auf Mobilität. Gute redaktionelle Arbeit macht solche Kontexte sichtbar, statt Einzelbefunde auf jede Form von KI-Kommunikation zu übertragen.

3. Menschlichkeit nicht mit Plauderton verwechseln

Die Befunde zu Wärme und Kompetenz legen nahe, dass Vertrauen nicht über Freundlichkeit allein entsteht. Eine zu locker formulierte Oberfläche kann sogar gegen Kompetenzsignale arbeiten, wenn sie Präzision ersetzt. Lesbarkeit ist wichtig, aber Einordnung, Trennschärfe und Belegarbeit sind wichtiger.

4. Transparenz als Qualitätsfrage behandeln, nicht als Risiko

Der Befund von Purcell et al. spricht gegen die pauschale Annahme, dass Offenlegung von KI-Nutzung automatisch Vertrauen senkt. Das bedeutet nicht, jede Nutzung prominent auszustellen. Wohl aber, dass Transparenz sinnvoller wird, wenn sie von redaktionellen Standards begleitet ist: Faktenprüfung, Verantwortlichkeit, Kennzeichnung von Unsicherheit, erkennbarer menschlicher Prüfprozess.

5. Detektorergebnisse nicht mit Beweisen verwechseln

Wer Textqualität darüber steuern will, ob ein Tool „menschlich“ oder „KI-erzeugt“ ausgibt, optimiert auf das falsche Ziel. Wissenschaftsnahe Qualität entsteht durch Quellenarbeit, fachliche Korrektheit und argumentativen Mehrwert, nicht durch ein möglichst unauffälliges statistisches Sprachprofil.

Ein praxistauglicher Redaktionsrahmen

Für Blogs und Fachportale lässt sich ein einfacher Arbeitsmodus ableiten: KI liefert Strukturvorschläge, Varianten und erste Rohfassungen. Der publizierbare Mehrwert entsteht danach.

| Qualitätsdimension | Prüffrage |

| Quellen | Ist jede starke Behauptung an eine konkrete, belastbare Quelle gebunden? |

| Geltungsbereich | Ist klar, in welchem Setting der zitierte Befund erhoben wurde? |

| Redaktion | Liefert der Text Einordnung, Gegenargumente und praktische Relevanz statt nur eine Zusammenfassung? |

| Stil | Entsteht Lesbarkeit durch Klarheit und Präzision oder nur durch Glättung? |

Mit diesem Raster verschiebt sich die Aufgabe von „KI-Text vermenschlichen“ zu „KI-Entwurf redaktionell verantworten“.

Handlungsempfehlungen

KI-gestützte Texte sollten weder romantisiert noch verteufelt werden. Der belastbarste Weg: KI als Entwurfs- und Strukturwerkzeug einsetzen, die publizistische Leistung klar in der Redaktion verankern.

Konkret heißt das:

- Rohtexte dürfen generisch sein. Veröffentlichte Texte nicht.

- Jeder empirische Satz braucht einen klar benennbaren Träger.

- Befunde aus wissenschaftlichen Quellen dürfen nur mit sauberem Kontext in Marketingtexte übersetzt werden.

- Vertrauen entsteht im Text über Wärme plus Kompetenz, nicht über bloße Lockerheit.

- Detektoren sind kein Qualitätsmaßstab für gute redaktionelle Arbeit.

FAQ

Was bedeutet „KI-Texte vermenschlichen“ in einem wissenschaftsnahen Sinn?

Gemeint ist nicht bloß ein natürlicherer Ton. Gemeint ist die Überarbeitung eines KI-Entwurfs so, dass der Text nachvollziehbare Perspektive, belastbare Aussagen, konkrete Einordnung und gut lesbare, präzise Sprache verbindet.

Senkt offengelegte KI-Nutzung automatisch das Vertrauen?

Nicht zwangsläufig. Entscheidend sind Kontext, Textqualität und die Frage, ob redaktionelle Verantwortung erkennbar bleibt.

Kann man KI-Texte zuverlässig erkennen?

Nicht eindeutig. Viele Detektoren arbeiten fehleranfällig und eignen sich eher als grober Hinweis denn als belastbarer Nachweis.

Warum reicht ein natürlicher Stil allein nicht aus?

Weil Vertrauen nicht nur durch Tonalität entsteht. Genauso wichtig sind fachliche Präzision, Einordnung, klare Begriffe und nachvollziehbare Argumente.

Aktuellste Artikel

KI-Texte vermenschlichen: Was Studien wirklich zeigen

Google AI Mode, WebMCP und die neue Logik digitaler Sichtbarkeit

Interne Verlinkung im SEO: PageRank, CheiRank und Crawl-Tiefe verstehen