Inhaltsverzeichnis

Was ist Real User Monitoring?

Real User Monitoring (RUM) erfasst Leistungsdaten direkt aus den Browsern echter Besucher, nicht aus simulierten Tests. Gemessen wird, wie eine Website unter realen Bedingungen performt: auf langsamen Mobilfunkverbindungen, schwächeren Endgeräten, in verschiedenen Regionen und mit unterschiedlichen Browserversionen.

Technisch läuft die Erfassung über ein JavaScript-Snippet oder ein Browser-SDK, das Metriken wie Ladezeiten, Interaktionsdaten, Fehler, Geräteinformationen und Core Web Vitals an eine Analyseplattform überträgt.

Für SEO-Teams ist RUM relevant, weil es zeigt, wo eine Website in der echten Nutzung leidet. Ein Lighthouse-Test kann unter kontrollierten Bedingungen gut aussehen und trotzdem auf realen Geräten oder in bestimmten Regionen deutlich schlechter performen. RUM schließt diese Lücke zwischen Labor und Wirklichkeit.

RUM, klassische Webanalyse und Synthetic Monitoring

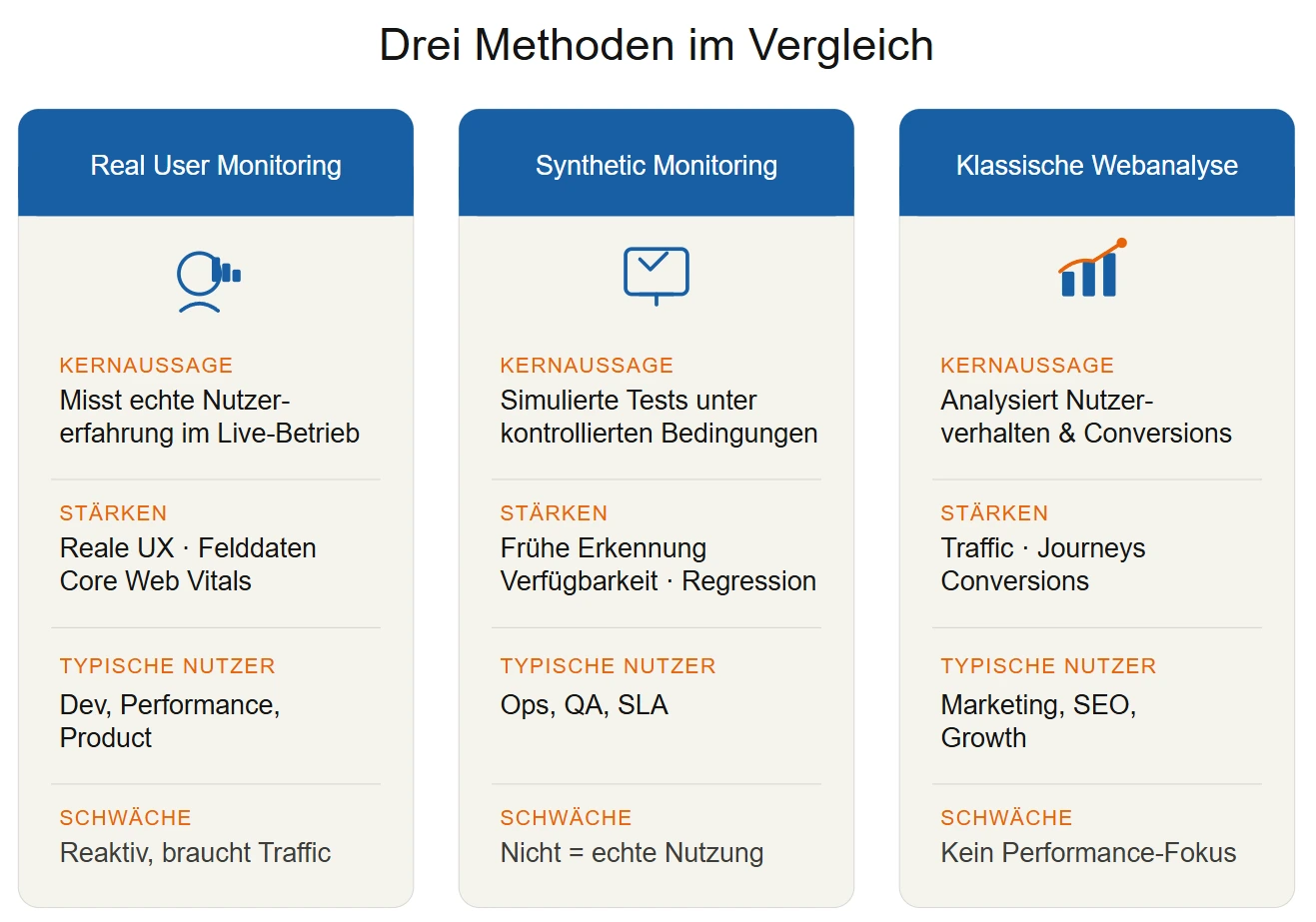

Diese drei Ansätze werden häufig verwechselt, lösen aber unterschiedliche Probleme.

Klassische Webanalyse beantwortet Marketing- und Verhaltensfragen: Woher kommen Besucher? Welche Seiten rufen sie auf? Wo finden Conversions statt? RUM beantwortet eine technische Frage: Wie gut funktioniert die Seite aus Sicht echter Nutzer in Bezug auf Ladezeit, Interaktivität und Fehler? Synthetic Monitoring arbeitet mit automatisierten, simulierten Tests. Es prüft Verfügbarkeit, misst definierte Abläufe und eignet sich für Regressionstests und Alarmierung unter kontrollierten, nicht realen Bedingungen.

Die drei Ansätze ersetzen sich nicht gegenseitig. Wer nur synthetisch misst, sieht reale Nutzerprobleme oft zu spät. Wer nur RUM nutzt, erkennt Ausfälle erst, wenn Besucher bereits betroffen sind.

Vorteile von RUM

Der größte Vorteil liegt in der Nähe zur Realität. RUM-Daten stammen aus echten Sitzungen und lassen sich nach Gerät, Browser, Region oder Seitentyp auswerten. Dadurch wird sichtbar, ob ein Problem nur auf mobilen Geräten auftaucht, nur bestimmte Länder betrifft oder durch einzelne Browserversionen ausgelöst wird.

Für Google-Rankings sind reale Core-Web-Vitals-Werte aus dem Feld aussagekräftiger als Laborwerte. Lighthouse-Scores weichen davon teilweise ab. RUM liefert genau diese Felddaten.

Moderne Frontends bestehen aus vielen JavaScript-Komponenten, Third-Party-Skripten und API-Abhängigkeiten. RUM macht Fehler entlang echter Nutzungspfade sichtbar. Traffic-Berichte liefern dazu keine Aussage.

Grenzen von RUM

RUM ist konzeptbedingt reaktiv: Ein Problem wird erst sichtbar, wenn reale Nutzer betroffen sind. Proaktive Alarmierung oder Regressionstests erfordern ergänzendes Synthetic Monitoring.

RUM lebt von ausreichend Traffic. Kleine Websites oder Nischenangebote liefern oft zu wenige Datenpunkte für statistisch belastbare Aussagen. Hinzu kommen Anforderungen an Datenschutz, Datensparsamkeit und Consent-Management, die je nach regulatorischem Umfeld unterschiedlich gelöst werden müssen.

Tool-Landschaft

Der Markt lässt sich grob in Enterprise-Observability-Suiten, stacknahe Plattformen und leichtere Website-Monitoring-Lösungen einteilen.

| Lösung | Kategorie | Typischer Fit |

| Datadog RUM | Enterprise Observability | SaaS, Product, Engineering |

| Dynatrace RUM | Enterprise Observability | Große Plattformen, komplexe Stacks |

| New Relic Browser | Observability-Plattform | Teams mit bestehender New-Relic-Nutzung |

| Akamai mPulse | DEM / Web Performance | Commerce, Media, große Websites |

| Elastic RUM | Stacknah | Technische Teams mit Elastic Stack |

| Pingdom RUM | Website Monitoring | KMU, Website-Operations |

| Cloudflare Web Analytics | Leichtgewicht / Privacy-first | Kleine und mittlere Websites |

GTmetrix gehört im Kern zur kontrollierten Performance-Analyse. Es eignet sich für reproduzierbare Tests und das Debugging konkreter Performance-Probleme, bildet aber nicht die Breite realer Nutzererfahrung ab.

Pingdom kombiniert Synthetic Monitoring und RUM in einem Tool, was für Teams ohne große Observability-Suite ausreichend sein kann.

Kosten

Der Listenpreis allein ist wenig aussagekräftig. Sampling, Session Replay, Datenaufbewahrung und interner Analyseaufwand können ein zunächst günstig wirkendes Setup im Betrieb merklich verteuern.

| Lösung | Kostenmodell | Einordnung |

| Datadog RUM | Nutzungsbasiert, öffentlich | Transparent, aber mit Session Replay schnell spürbar |

| Dynatrace RUM | Sessionbasiert (Rate Card) | Leistungsfähig, klar Enterprise-nah |

| New Relic Browser | Plattform- und nutzungsbasiert | Für Einsteiger schwerer kalkulierbar |

| Akamai mPulse | Angebotsmodell | Für KMU weniger planbar |

| Pingdom | Website-Monitoring-orientiert | Zugänglicher als große Observability-Suiten |

| Cloudflare Web Analytics | Sehr niedrige Einstiegshürde | Für kleinere Websites geeignet |

Ein schlankes Setup mit geringerem Funktionsumfang ist für KMU oft wirtschaftlich sinnvoller als eine große Suite, deren Potenzial intern nicht ausgeschöpft wird.

Integrationsaufwand

Der technische Einstieg ist meist überschaubar. In vielen Fällen reicht zunächst ein JavaScript-Snippet oder ein Browser-SDK. Der eigentliche Aufwand entsteht durch Governance, Consent-Management, Sampling, Dashboards, Datenqualität und die Einbindung in bestehende Entwicklungsprozesse.

| Lösung | Technischer Aufwand | Kommentar |

| Cloudflare Web Analytics | Niedrig | Sehr schneller Einstieg |

| Pingdom RUM | Niedrig bis mittel | Für klassische Websites gut beherrschbar |

| New Relic Browser | Niedrig bis mittel | Skaliert mit Plattformnutzung |

| Datadog RUM | Mittel | Gut für moderne Frontends |

| Elastic RUM | Mittel bis hoch | Sinnvoll vor allem mit vorhandenem Elastic-Wissen |

| Dynatrace RUM | Mittel bis hoch | Stark, aber mit mehr organisatorischem Aufwand |

| Akamai mPulse | Mittel bis hoch | Interessant in großen Delivery-Umgebungen |

SEO-freundliche Integration

Das RUM-Skript wird asynchron eingebunden, um den kritischen Rendering-Pfad nicht zu belasten. Sampling reduziert den Overhead, ohne den Informationswert wesentlich zu mindern. Sinnvoll zu messen sind Interaktivität, Ladeverhalten, Rendering-Probleme und Unterschiede nach Gerät oder Region, nicht möglichst viele Datenpunkte.

Welche Lösung passt zu wem?

Für kleine und mittlere Websites sind planbare, organisatorisch schlanke Lösungen die bessere Wahl. Cloudflare Web Analytics oder Pingdom sind leichter zugänglich. Wer bereits New Relic nutzt, kann Browser Monitoring ergänzen, ohne einen neuen Stack aufzubauen.

Für größere Plattformen mit komplexen Architekturen, internationalen Märkten und hohen Anforderungen an Fehleranalyse und Plattformtransparenz kommen Datadog, Dynatrace oder Akamai mPulse in Frage. Dort spielt die Integration mit dem restlichen Observability- und Delivery-Stack eine größere Rolle als der reine Snippet-Einbau.

FAQ

RUM ist eine Methode zur Messung realer Nutzererfahrung auf Websites und Webanwendungen. Performance-, Interaktions- und Fehlerdaten werden direkt im Browser echter Besucher erfasst.

RUM misst echte Sitzungen realer Nutzer. Synthetic Monitoring arbeitet mit simulierten Tests in kontrollierten Umgebungen. Beide Ansätze ergänzen sich, weil sie unterschiedliche Perspektiven liefern.

Datadog RUM, Dynatrace RUM, New Relic Browser, Akamai mPulse, Elastic RUM und Pingdom RUM. Cloudflare Web Analytics ist ein leichter, privacy-orientierter Einstieg.

Das hängt vom Tool und Nutzungsmodell ab. Enterprise-Lösungen können mit steigendem Traffic und Session Replay merklich teurer werden. Für KMU sind planbare, schlankere Varianten oft die bessere Wahl.

Asynchrone Einbindung, Sampling und Fokus auf relevante Performance-Metriken sind die wesentlichen Punkte. Der kritische Rendering-Pfad sollte durch das Monitoring nicht zusätzlich belastet werden.

Aktuellste Artikel

Real User Monitoring: Vorteile, Tools, Kosten und SEO-Integration

SSG, SSR und CSR verständlich erklärt: Rendering, ISR, SEO und Crawling für moderne Websites

Claude Mythos Preview: Risiko für die Cybersicherheit?